فهرست مطالب

پادکست مقایسه و توضیح Docker و Kubernetes

۱. مقدمه: دگردیسی زیرساختهای محاسباتی و ظهور عصر کانتینر

تاریخ مهندسی نرمافزار و زیرساختهای فناوری اطلاعات، روایتی از تلاش مستمر برای انتزاع (Abstraction) و کارایی است. در دهههای گذشته، استقرار نرمافزار فرآیندی وابسته به سختافزار بود که نیازمند تأمین سرورهای فیزیکی، پیکربندی دستی سیستمعاملها و مدیریت پیچیدهی وابستگیها بود. این مدل سنتی، که اغلب با عنوان معماری “Monolithic” یا یکپارچه شناخته میشود، با چالشهای جدی در مقیاسپذیری، بهرهوری منابع و چابکی مواجه بود. ظهور مجازیسازی (Virtualization) نخستین گام بزرگ در جهت رفع این محدودیتها بود؛ فناوریای که اجازه میداد چندین سیستمعامل مهمان بر روی یک سختافزار واحد اجرا شوند.1 با این حال، حتی ماشینهای مجازی (VMs) نیز به دلیل سربار بالای سیستمعاملهای متعدد، پاسخگوی نیازهای شتابان توسعه نرمافزار در عصر دیجیتال نبودند.

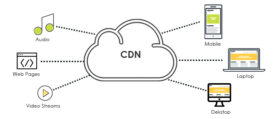

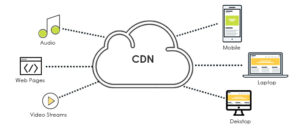

امروزه، ما در عصر “بومی ابری” یا Cloud Native زندگی میکنیم. این پارادایم جدید که بر پایهی کانتینرها (Containers)، میکروسرویسها (Microservices) و زیرساختهای تغییرناپذیر (Immutable Infrastructure) بنا شده است، نحوه طراحی، توسعه و استقرار نرمافزار را به کلی دگرگون کرده است.2 در قلب این انقلاب، دو فناوری کلیدی قرار دارند: Docker به عنوان استاندارد صنعتی برای بستهبندی و اجرای کانتینرها، و Kubernetes به عنوان پلتفرم ارکستراسیون (Orchestration) که مدیریت این کانتینرها را در مقیاسهای عظیم ممکن میسازد.3

این گزارش تحقیقاتی جامع، با هدف ارائه یک مرجع تخصصی و عمیق، به بررسی تمامی ابعاد این اکوسیستم میپردازد. ما از تعاریف بنیادین بنیاد محاسبات ابری بومی (CNCF) آغاز کرده، تفاوتهای تکنیکال کانتینرسازی و مجازیسازی را موشکافی میکنیم، و سپس راهنمای گامبهگام و فنی نصب Docker بر روی سرورهای لینوکسی (Ubuntu و CentOS) را ارائه میدهیم. در ادامه، معماری پیچیده Kubernetes و اجزای آن تشریح شده و در نهایت به روندهای نوین سال ۲۰۲۵ مانند eBPF، WebAssembly و نقش Kubernetes در بارهای کاری هوش مصنوعی (AI) پرداخته خواهد شد.

۲. معماری Cloud Native: فلسفه، اصول و تعاریف

۲.۱ تعریف رسمی و مدرن Cloud Native

اصطلاح “Cloud Native” یا بومی ابری، فراتر از صرفاً اجرای نرمافزار در محیطهای ابری عمومی (Public Cloud) است. بر اساس تعریف رسمی ارائه شده توسط بنیاد محاسبات ابری بومی (CNCF)، تکنولوژیهای Cloud Native سازمانها را قادر میسازند تا برنامههای مقیاسپذیر را در محیطهای مدرن و پویا مانند ابرهای عمومی، خصوصی و هیبریدی بسازند و اجرا کنند.2

این رویکرد با ویژگیهای کلیدی زیر شناخته میشود:

- کانتینرها (Containers): واحدهای مستقل و قابل حمل نرمافزاری.

- سرویس مش (Service Meshes): لایهای برای مدیریت ارتباطات پیچیده بین سرویسها.

- میکروسرویسها (Microservices): معماری تقسیم برنامه به سرویسهای کوچک و مستقل.

- زیرساخت تغییرناپذیر (Immutable Infrastructure): سرورهایی که پس از استقرار هرگز اصلاح نمیشوند، بلکه جایگزین میگردند.

- APIهای اعلانی (Declarative APIs): تعریف وضعیت مطلوب سیستم به جای دستورالعملهای گامبهگام.2

این تکنیکها سیستمهایی با وابستگیهای ضعیف (Loosely Coupled) را ممکن میسازند که تابآور (Resilient)، قابل مدیریت و مشاهدهپذیر (Observable) هستند. همراه با اتوماسیون قوی، این رویکرد به مهندسان اجازه میدهد تا تغییرات با تأثیر بالا را به صورت مکرر و قابل پیشبینی با حداقل زحمت اعمال کنند.6 هدف نهایی، جداسازی برنامه از زیرساخت زیرین است که قابلیت “یک بار بنویس، هرجا اجرا کن” را محقق میسازد.7

۲.۲ نقش بنیاد CNCF در اکوسیستم

بنیاد CNCF که در سال ۲۰۱۵ تأسیس شد، به عنوان قطب اصلی و بیطرف (Vendor-neutral) برای توسعه و ترویج این فناوریها عمل میکند. این بنیاد با میزبانی بیش از ۲۱۲ پروژه (از جمله Kubernetes و Prometheus) و جلب مشارکت بیش از ۲۹۸,۰۰۰ نفر از ۱۹۲ کشور، تلاش میکند تا الگوهای پیشرفته را دموکراتیزه کرده و دسترسی به این نوآوریها را برای همگان فراهم کند.8 اهمیت CNCF در جلوگیری از انحصار شرکتهای بزرگ و تضمین استانداردهای باز است که به پایداری و بقای طولانیمدت اکوسیستم کمک میکند.5

۳. کانتینرسازی در مقابل مجازیسازی: تحلیل تکنیکال و مقایسهای

برای درک عمیق جایگاه Docker و Kubernetes، لازم است تفاوتهای بنیادین میان کانتینرها و ماشینهای مجازی (VMs) را از منظر معماری سیستمعامل و تخصیص منابع بررسی کنیم. هر دو تکنولوژی هدف مشترکی دارند: ایزولهسازی برنامهها از زیرساخت فیزیکی، اما روش دستیابی به این هدف متفاوت است.1

۳.۱ تفاوتهای معماری و ساختاری

ماشینهای مجازی (Virtual Machines):

مجازیسازی سنتی بر پایه یک لایه نرمافزاری به نام “هایپروایزر” (Hypervisor) عمل میکند که مستقیماً روی سختافزار (Type 1) یا روی سیستمعامل میزبان (Type 2) قرار میگیرد. هر ماشین مجازی (VM) شامل یک کپی کامل از سیستمعامل مهمان (Guest OS)، کرنل اختصاصی، باینریها و کتابخانهها است.1 این معماری باعث میشود که VMها سنگین باشند؛ حجم هر VM ممکن است به چندین گیگابایت برسد و بارگذاری سیستمعامل مهمان زمانبر است.3

کانتینرها (Containers):

در مقابل، کانتینرها نوعی مجازیسازی در سطح سیستمعامل هستند. آنها فاقد هایپروایزر و سیستمعامل مهمان اختصاصی هستند. در عوض، تمام کانتینرها بر روی یک سیستمعامل میزبان واحد اجرا میشوند و کرنل (Kernel) آن سیستمعامل را به اشتراک میگذارند.1 ایزولهسازی در کانتینرها از طریق قابلیتهای کرنل لینوکس مانند Namespaces (برای ایزوله کردن فضای فرآیندها، شبکه و فایلسیستم) و cgroups (برای محدود کردن منابع مصرفی مثل CPU و RAM) انجام میشود.11

۳.۲ عملکرد و بهرهوری منابع (Performance & Efficiency)

حذف لایه هایپروایزر و سیستمعامل مهمان، مزایای عملکردی قابل توجهی به کانتینرها میدهد:

- سرعت راهاندازی: از آنجا که کانتینر نیازی به بوت کردن یک سیستمعامل کامل ندارد، زمان راهاندازی آن در حد میلیثانیه یا ثانیه است، در حالی که VMها ممکن است دقیقهها طول بکشند.12

- چگالی (Density): یک سرور فیزیکی میتواند تعداد بسیار بیشتری کانتینر را نسبت به ماشین مجازی میزبانی کند. این امر باعث افزایش بهرهوری سرور و کاهش هزینههای لایسنس و سختافزار میشود.11

- سربار کمتر (Reduced Overhead): کانتینرها تنها باینریها و کتابخانههای مورد نیاز برنامه را بستهبندی میکنند، بنابراین حجم آنها بسیار کم (در حد مگابایت) است.10

- عملکرد نزدیک به فلز (Near Bare-Metal Performance): کانتینرها به دلیل ارتباط مستقیمتر با کرنل میزبان و حذف لایههای واسط، عملکردی بسیار نزدیک به اجرای مستقیم روی سختافزار (Bare Metal) دارند و تا ۶۰٪ عملکرد بهتری نسبت به VMها در برخی سناریوها ارائه میدهند.13

۳.۳ امنیت و ایزولهسازی

اگرچه کانتینرها سریعتر هستند، اما VMها به طور سنتی ایزولهسازی قویتری ارائه میدهند. در VM، اگر کرنل یک سیستمعامل مهمان دچار مشکل شود، سایر VMها تحت تأثیر قرار نمیگیرند. اما در کانتینرها، چون کرنل مشترک است، یک آسیبپذیری در کرنل میزبان میتواند تمامی کانتینرها را به خطر بیندازد.12 با این حال، پیشرفتهای مدرن در کانتینرهای امن و تکنولوژیهایی مانند MicroVMs (مثل Firecracker) در حال کاهش این فاصله هستند.

جدول مقایسهای: کانتینر در برابر ماشین مجازی

| ویژگی | ماشین مجازی (VM) | کانتینر (Container) |

| لایه مجازیسازی | سختافزار (Hypervisor) | سیستمعامل (Container Engine) |

| سیستمعامل | سیستمعامل مهمان مستقل برای هر VM | کرنل مشترک سیستمعامل میزبان |

| حجم | سنگین (گیگابایت) | سبک (مگابایت) |

| زمان راهاندازی | کند (دقیقهها) | بسیار سریع (ثانیهها/میلیثانیهها) |

| ایزولهسازی | بسیار بالا (سختافزاری) | متوسط (سطح فرآیند/Process) |

| قابلیت حمل | محدود (وابسته به فرمت VM) | بسیار بالا (هر جا که Docker باشد) |

| کاربرد اصلی | اجرای چندین OS مختلف، امنیت بالا | میکروسرویسها، چابکی بالا، تراکم بالا |

1

۴. Docker: موتور محرک تحویل نرمافزار مدرن

داکر (Docker) پلتفرمی متنباز است که فرآیند ایجاد، استقرار و اجرای برنامهها را با استفاده از کانتینرها تسهیل میکند. اگرچه مفهوم کانتینر قبل از داکر وجود داشت (مانند LXC)، داکر با استانداردسازی فرمت کانتینرها و ارائه ابزارهای ساده برای توسعهدهندگان، انقلابی در این عرصه ایجاد کرد.3

۴.۱ معماری Docker

معماری داکر بر اساس مدل کلاینت-سرور (Client-Server) طراحی شده است و شامل سه مؤلفه اصلی است 17:

- Docker Daemon (

dockerd): این بخش به عنوان “مغز” سیستم عمل میکند. یک فرآیند پسزمینه (Daemon) که بر روی سیستم میزبان اجرا میشود و مسئولیت مدیریت اشیاء داکر (مانند ایمیجها، کانتینرها، شبکهها و والیومها) را بر عهده دارد. این دیمون درخواستهای API را گوش میدهد و عملیات سنگین کانتینرسازی را مدیریت میکند.19 - Docker Client (

docker): رابط اصلی کاربر با داکر است. وقتی شما دستوری مانندdocker runرا تایپ میکنید، این کلاینت درخواست را از طریق API به دیمون ارسال میکند.18 کلاینت میتواند به دیمون محلی یا یک دیمون راه دور متصل شود. - Docker Registry: مکانی برای ذخیرهسازی و توزیع ایمیجهای داکر است. Docker Hub معروفترین رجیستری عمومی است، اما سازمانها میتوانند رجیستریهای خصوصی خود را نیز داشته باشند.17

۴.۲ اجزای کلیدی: ایمیج و کانتینر

- Docker Image: یک قالب فقط خواندنی (Read-only) است که شامل کد برنامه، کتابخانهها، وابستگیها و تنظیمات لازم برای اجرای برنامه میباشد. ایمیجها به صورت لایهلایه ساخته میشوند؛ هر تغییر در کد تنها لایه مربوطه را تغییر میدهد که باعث کارایی بالا در ذخیرهسازی و انتقال میشود.17

- Docker Container: یک نمونه قابل اجرا (Runnable Instance) از یک ایمیج است. کانتینر محیطی ایزوله را فراهم میکند که برنامه در آن اجرا میشود. کانتینرها موقتی هستند و میتوانند ایجاد، شروع، متوقف و حذف شوند.18

۵. راهنمای جامع و فنی نصب Docker بر روی سرور

برای ورود عملی به دنیای کانتینرها، نصب صحیح Docker Engine بر روی سرورهای لینوکسی ضروری است. در اینجا روش نصب استاندارد بر روی دو توزیع محبوب سرور، یعنی Ubuntu و CentOS، بر اساس مستندات رسمی ارائه میشود.

۵.۱ آموزش نصب Docker روی سرور Ubuntu

اوبونتو (Ubuntu) یکی از پرکاربردترین توزیعها برای محیطهای Cloud Native است. روش پیشنهادی استفاده از مخزن (Repository) رسمی داکر است.21

مرحله ۱: آمادهسازی و نصب پیشنیازها

ابتدا لیست پکیجها را بهروزرسانی کرده و ابزارهای لازم برای استفاده از مخازن HTTPS را نصب کنید:

Bash

sudo apt-get update

sudo apt-get install ca-certificates curl gnupg

سپس، کلید GPG رسمی داکر را اضافه کنید. این کلید برای تأیید اصالت پکیجها ضروری است:

Bash

sudo install -m 0755 -d /etc/apt/keyrings

curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

مرحله ۲: اضافه کردن مخزن داکر

دستور زیر مخزن پایدار داکر را به لیست منابع سیستم شما اضافه میکند:

Bash

echo \

"deb [arch="$(dpkg --print-architecture)" signed-by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/ubuntu \

"$(. /etc/os-release && echo "$VERSION_CODENAME")" stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

22

مرحله ۳: نصب موتور داکر (Docker Engine)

مجدداً لیست پکیجها را بهروزرسانی کرده و آخرین نسخه داکر، کلاینت، و پلاگینهای مربوطه را نصب کنید:

Bash

sudo apt-get update

sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

22

مرحله ۴: صحتسنجی نصب

برای اطمینان از نصب صحیح، ایمیج تست hello-world را اجرا کنید:

Bash

sudo docker run hello-world

این دستور یک ایمیج کوچک را دانلود و اجرا میکند و در صورت موفقیت، پیامی مبنی بر نصب صحیح نمایش میدهد.22

۵.۲ آموزش نصب Docker روی سرور CentOS

برای سیستمهای مبتنی بر RHEL مانند CentOS، مراحل کمی متفاوت است.24

مرحله ۱: تنظیم مخزن

بسته dnf-plugins-core را نصب کرده و مخزن داکر را اضافه کنید:

Bash

sudo dnf -y install dnf-plugins-core

sudo dnf config-manager --add-repo https://download.docker.com/linux/centos/docker-ce.repo

24

مرحله ۲: نصب پکیجهای داکر

دستور زیر آخرین نسخه داکر انجین را نصب میکند:

Bash

sudo dnf install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

24

مرحله ۳: فعالسازی و شروع سرویس

برخلاف اوبونتو، در CentOS سرویس داکر پس از نصب به صورت خودکار اجرا نمیشود. باید آن را دستی استارت و فعال کنید تا در بوتهای بعدی نیز اجرا شود:

Bash

sudo systemctl enable --now docker

24

۵.۳ پیکربندیهای پس از نصب (Post-Installation)

به طور پیشفرض، دیمون داکر با دسترسی root اجرا میشود و برای اجرای دستورات باید از sudo استفاده کنید. برای اجرای دستورات بدون sudo، باید کاربر فعلی را به گروه docker اضافه کنید:

- ایجاد گروه داکر (معمولاً در نصب ایجاد میشود):Bash

sudo groupadd docker - اضافه کردن کاربر جاری به گروه:Bash

sudo usermod -aG docker $USER - اعمال تغییرات (خروج و ورود مجدد یا استفاده از دستور زیر):Bash

newgrp docker

24

۶. Kubernetes: سیستمعامل ابر و ارکستراسیون کانتینرها

در حالی که داکر مشکل بستهبندی و اجرای یک کانتینر را حل میکند، در محیطهای عملیاتی بزرگ که صدها یا هزاران کانتینر (میکروسرویس) باید به صورت هماهنگ کار کنند، مدیریت دستی غیرممکن است. اینجاست که Kubernetes (یا به اختصار K8s) وارد میشود. کوبرنتیز یک پلتفرم متنباز برای “ارکستراسیون کانتینرها” است که وظایف استقرار، مقیاسدهی (Scaling) و مدیریت کانتینرها را خودکار میکند.25

۶.۱ چرا به ارکستراسیون نیاز داریم؟

در یک معماری میکروسرویس، برنامه شما ممکن است از دهها سرویس مختلف تشکیل شده باشد که هر کدام در کانتینرهای جداگانه اجرا میشوند. کوبرنتیز مانند یک “پلیس راهنمایی و رانندگی” یا “مدیر ارشد” عمل میکند که تصمیم میگیرد کدام کانتینر روی کدام سرور اجرا شود، در صورت خرابی یک سرور کانتینرها را جابجا کند، و در زمان اوج ترافیک تعداد آنها را افزایش دهد.4

۶.۲ معماری کلاستر Kubernetes

یک کلاستر کوبرنتیز از دو بخش اصلی تشکیل شده است: Control Plane (مغز سیستم) و Worker Nodes (بازوهای اجرایی).4

۶.۲.۱ اجزای Control Plane

این لایه تصمیمات کلی کلاستر را میگیرد و رویدادها را مدیریت میکند:

- API Server (

kube-apiserver): دروازه ورودی کلاستر. تمام دستورات داخلی و خارجی (از طریقkubectl) به این سرور ارسال میشود. این تنها جزئی است که مستقیماً با دیتابیسetcdصحبت میکند.25 - etcd: حافظه کلاستر. یک دیتابیس Key-Value توزیعشده و بسیار پایدار که وضعیت کل کلاستر را ذخیره میکند.27

- Scheduler (

kube-scheduler): وظیفه زمانبندی را بر عهده دارد. پادهای جدید را میبیند و بر اساس منابع مورد نیاز (CPU/RAM) و محدودیتها، بهترین نود (Node) را برای اجرای آنها انتخاب میکند.25 - Controller Manager (

kube-controller-manager): شامل کنترلرهایی است که وضعیت جاری سیستم را با وضعیت مطلوب (Desired State) مقایسه میکنند. مثلاً اگر یک پاد از کار بیفتد، کنترلر مسئول ایجاد یک پاد جدید است.4

۶.۲.۲ اجزای Worker Nodes

نودها ماشینهای فیزیکی یا مجازی هستند که برنامهها روی آنها اجرا میشوند:

- Kubelet: نمایندهای که روی هر نود اجرا میشود و مطمئن میشود کانتینرهای تعریف شده در پاد، سالم و در حال اجرا هستند.25

- Kube-proxy: وظیفه مدیریت قوانین شبکه روی هر نود را دارد و ارتباطات شبکهای به پادها را امکانپذیر میکند.25

- Container Runtime: نرمافزاری که عملاً کانتینرها را اجرا میکند (مانند containerd یا CRI-O).27

۶.۳ اشیاء (Objects) کلیدی در Kubernetes

کوبرنتیز از یک API اعلانی (Declarative) استفاده میکند؛ یعنی شما “آنچه میخواهید” را تعریف میکنید، نه “چگونگی انجام آن” را.

- Pod: کوچکترین واحد قابل استقرار در کوبرنتیز. یک پاد میتواند شامل یک یا چند کانتینر باشد که منابع شبکه و ذخیرهسازی مشترک دارند.4

- Deployment: برای مدیریت نسخه و آپدیت پادها استفاده میشود. به شما امکان میدهد پادها را به صورت Rolling Update (بدون قطعی) بهروزرسانی کنید.27

- StatefulSet: برای برنامههایی که نیاز به ذخیره وضعیت دارند (مانند دیتابیسها) استفاده میشود تا هویت و ترتیب پادها حفظ شود.27

- DaemonSet: تضمین میکند که روی تمام (یا برخی) نودها یک نسخه از پاد اجرا شود (مناسب برای ابزارهای مانیتورینگ یا لاگگیری).27

۷. شبکه و سرویسها در Kubernetes

در محیط پویای کوبرنتیز، پادها موقتی هستند؛ آنها میمیرند و با IP جدید زنده میشوند. بنابراین، نمیتوان به IP پادها تکیه کرد. کوبرنتیز این مشکل را با مفهومی به نام Service حل میکند.

انواع سرویسها (Services)

سرویس یک انتزاع پایدار برای دسترسی به مجموعهای از پادها است 27:

- ClusterIP: نوع پیشفرض. سرویس را روی یک IP داخلی کلاستر در دسترس قرار میدهد. فقط از داخل کلاستر قابل دسترسی است (مناسب برای ارتباط میکروسرویسهای داخلی).30

- NodePort: سرویس را روی یک پورت ثابت در تمام نودهای کلاستر باز میکند. ترافیک خارجی میتواند با زدن

NodeIP:NodePortبه سرویس برسد.27 - LoadBalancer: از لود بالانسر ارائهدهنده ابری (مانند AWS یا Google Cloud) استفاده میکند تا سرویس را به اینترنت متصل کند.29

- ExternalName: سرویس را به یک نام DNS خارجی (CNAME) نگاشت میکند.27

نکته بهترین روش (Best Practice): برای محیطهای عملیاتی، استفاده از Ingress توصیه میشود. Ingress به جای ایجاد یک لود بالانسر گرانقیمت برای هر سرویس، به عنوان یک لایه مسیریابی هوشمند (مانند Nginx) عمل میکند و ترافیک HTTP/HTTPS را بر اساس دامین یا مسیر به سرویسهای مختلف هدایت میکند.32

۸. قابلیتهای پیشرفته: مقیاسپذیری خودکار و خودترمیمی

یکی از مزایای اصلی Cloud Native، خاصیت ارتجاعی (Elasticity) است. کوبرنتیز ابزارهای قدرتمندی برای این منظور دارد.

۸.۱ مقیاسدهی خودکار (Autoscaling)

سه مکانیسم اصلی برای مقیاسدهی وجود دارد 34:

- Horizontal Pod Autoscaler (HPA): تعداد پادها را بر اساس مصرف CPU یا متریکهای سفارشی (مانند تعداد درخواستها) کم و زیاد میکند. (Scale Out/In).34

- Vertical Pod Autoscaler (VPA): به جای افزایش تعداد پاد، میزان منابع (CPU/RAM) اختصاص یافته به پاد موجود را تغییر میدهد. (Scale Up/Down).34

- Cluster Autoscaler: اگر نودهای فعلی ظرفیت اجرای پادهای جدید را نداشته باشند، این سیستم به طور خودکار نودهای جدیدی به کلاستر اضافه میکند (تغییر در زیرساخت).34

۸.۲ مکانیزم خودترمیمی (Self-Healing)

کوبرنتیز دائماً تلاش میکند “وضعیت جاری” را به “وضعیت مطلوب” برساند.

- اگر کانتینری کرش کند، Kubelet آن را ریستارت میکند.34

- اگر یک نود به کلی از مدار خارج شود، Controller Manager پادهای آن نود را روی نودهای سالم دیگر مجدداً زمانبندی میکند.25

- با استفاده از Liveness Probes و Readiness Probes، کوبرنتیز سلامت برنامه را چک میکند. اگر برنامه زنده نباشد، ریستارت میشود و اگر آماده پاسخگویی نباشد، ترافیک به آن ارسال نمیشود.26

۹. روندهای نوین ۲۰۲۵ و آینده تکنولوژیهای Cloud Native

اکوسیستم Cloud Native در سال ۲۰۲۵ فراتر از کانتینرهای ساده رفته و تکنولوژیهای جدیدی را ادغام کرده است.

۹.۱ eBPF: انقلابی در مشاهدهپذیری و امنیت

فناوری eBPF (Extended Berkeley Packet Filter) به برنامهها اجازه میدهد بدون تغییر کد منبع کرنل لینوکس، درون کرنل اجرا شوند.36 این فناوری مانند “JavaScript برای کرنل” عمل میکند و تحولی در ابزارهای مانیتورینگ و امنیت ایجاد کرده است. ابزارهای مبتنی بر eBPF میتوانند بدون نیاز به تزریق “Sidecar”های سنگین، تمام ترافیک شبکه و فراخوانهای سیستمی را با سربار بسیار ناچیز رصد کنند و امنیت را در سطح هسته سیستمعامل تأمین نمایند.38

۹.۲ WebAssembly (Wasm) در سمت سرور

اگرچه Wasm برای مرورگرها طراحی شد، اما به دلیل سرعت فوقالعاده بالا و امنیت ذاتی (Sandboxing)، به عنوان جایگزینی سبک برای کانتینرها در محاسبات لبه (Edge) و Serverless مطرح شده است.41 ماژولهای Wasm در میکروثانیه اجرا میشوند و در سال ۲۰۲۵ شاهد اجرای همزمان کانتینرهای Docker و ماژولهای Wasm در کلاسترهای کوبرنتیز هستیم.43

۹.۳ هوش مصنوعی در کوبرنتیز (Cloud Native AI)

کوبرنتیز به پلتفرم استاندارد برای بارهای کاری هوش مصنوعی (AI/ML) تبدیل شده است.44

- مدیریت GPU: کوبرنتیز امکان اشتراکگذاری و تخصیص دقیق منابع GPU را فراهم میکند که برای آموزش مدلهای سنگین حیاتی است.45

- قابلیت حمل: مدلهای کانتینریزه شده میتوانند به راحتی بین لپتاپ دیتاساینتیست و کلاسترهای عظیم ابری جابجا شوند.47

۱۰. مقایسه کاربردی: Docker Compose در برابر Kubernetes

در حالی که کوبرنتیز استاندارد محیطهای عملیاتی است، Docker Compose همچنان ابزاری محبوب برای محیطهای توسعه است.

| ویژگی | Docker Compose | Kubernetes |

| محدوده | تک میزبان (Single Host) | کلاستر توزیعشده (Multi-Host) |

| کاربرد | توسعه محلی، تست، پروژههای کوچک | محیط عملیاتی (Production)، مقیاس بالا |

| پیکربندی | فایل ساده docker-compose.yml |

فایلهای پیچیده YAML (Manifests) |

| مقیاسدهی | دستی (با دستور scale) | خودکار (HPA, VPA, Autoscaler) |

| خودترمیمی | محدود (ریستارت ساده) | پیشرفته (زمانبندی مجدد، چک سلامت) |

| پیچیدگی | کم (یادگیری آسان) | زیاد (نیاز به تخصص بالا) |

48

توسعهدهندگان معمولاً ساختار برنامه را در Docker Compose برای تست سریع روی لپتاپ تعریف میکنند، اما برای استقرار نهایی، این تعاریف به مانیفستهای کوبرنتیز ترجمه میشوند تا از قدرت کامل ارکستراسیون بهرهمند شوند.49

۱۱. امنیت زنجیره تأمین نرمافزار (Supply Chain Security)

با گسترش استفاده از کانتینرها، امنیت زنجیره تأمین به چالشی بزرگ تبدیل شده است. مفهوم SBOM (صورتحساب مواد نرمافزار) به عنوان استانداردی برای شفافیت اجزای نرمافزار مطرح شده است.53 ابزارهای مدرن به طور خودکار SBOM را برای هر ایمیج کانتینر تولید میکنند تا در صورت کشف آسیبپذیری (مانند Log4j)، سازمانها بتوانند فوراً تمامی کانتینرهای آسیبپذیر را شناسایی کنند.54 همچنین رویکرد Policy as Code (مانند استفاده از OPA Gatekeeper) تضمین میکند که هیچ کانتینری بدون رعایت استانداردهای امنیتی (مثلاً اجرا نشدن با کاربر root) وارد کلاستر نشود.55

۱۲. نتیجهگیری

گذار به معماری Cloud Native فراتر از یک تغییر تکنولوژیک صرف است؛ این یک دگرگونی بنیادین در نحوه خلق ارزش از طریق نرمافزار است. با جداسازی برنامهها از زیرساخت توسط کانتینرها، سازمانها به قابلیت حمل و بهرهوری دست مییابند. با مدیریت این کانتینرها توسط Kubernetes، آنها به تابآوری و مقیاسپذیری لازم برای اقتصاد دیجیتال مدرن میرسند.

اکوسیستم همچنان در حال بلوغ است. در حالی که داکر واحد استاندارد نرمافزار و کوبرنتیز پلتفرم اجرای آن را فراهم کردند، مرزهای جدید در بهینهسازی این پلتفرم نهفته است. تکنولوژیهایی مانند eBPF زیرساخت را از درون شفافتر و امنتر میکنند، WebAssembly مرزهای اجرای سبک در لبه شبکه را جابجا میکند، و ارکستراسیون مبتنی بر هوش مصنوعی شروع به خودکارسازی پیچیدگیهای مدیریت این سیستمهای توزیعشده کرده است. برای شرکتهای پیشرو، سوال دیگر “چرایی” استفاده از این ابزارها نیست، بلکه “چگونگی” ادغام مؤثر آنها با امنیت زنجیره تأمین و مشاهدهپذیری پیشرفته برای ساخت سیستمهای تابآور فرداست.