مقدمه: معرفی مقیاسپذیری خودکار (Auto Scaling)

در محیطهای ابری مدرن، مدیریت بهینه منابع یکی از چالشهای کلیدی کسبوکارهاست. تقاضا برای سرویسها میتواند به صورت غیرقابل پیشبینی نوسان کند و تخصیص دستی منابع برای پاسخگویی به این تغییرات، هم ناکارآمد و هم مستعد خطا است. در اینجاست که مقیاسپذیری خودکار یا Auto Scaling به عنوان یک قابلیت استراتژیک در محاسبات ابری وارد میدان میشود. Auto Scaling یک روش پویاست که به طور خودکار تعداد منابع محاسباتی (مانند سرورهای مجازی) را بر اساس بار واقعی و لحظهای تنظیم میکند. این قابلیت، فراتر از یک ویژگی فنی، یک اصل بنیادین در معماری ابر مدرن است که چابکی کسبوکار را ممکن میسازد. این رویکرد نه تنها با حذف منابع اضافی در زمانهای کمترافیک به کاهش چشمگیر هزینهها منجر میشود، بلکه با افزودن سریع منابع در زمان اوج تقاضا، پایداری و در دسترس بودن سرویسها را تضمین میکند. در نتیجه، Auto Scaling به یک ابزار ضروری برای ساخت زیرساختهای انعطافپذیر، کارآمد و آماده برای رشد در دنیای دیجیتال امروز تبدیل شده است.

۱. مفاهیم بنیادی: مقیاسپذیری خودکار چگونه کار میکند؟

برای پیادهسازی صحیح و مؤثر Auto Scaling، ابتدا باید با اصول اولیه و مکانیسمهای کلیدی آن آشنا شویم. درک این مفاهیم بنیادی به معماران و توسعهدهندگان کمک میکند تا استراتژی مناسبی را برای بارهای کاری خود انتخاب کرده و از مزایای کامل این تکنولوژی بهرهمند شوند.

۱.۱. مقیاسپذیری افقی در مقابل مقیاسپذیری عمودی

دو رویکرد اصلی برای تنظیم ظرفیت منابع وجود دارد که هر کدام برای سناریوهای متفاوتی مناسب هستند:

- مقیاسپذیری افقی (Horizontal Scaling / Scale-Out): این روش به معنای افزودن سرورها (instances) یا حذف آنها از مجموعه منابع برای توزیع بار کاری است. تصور کنید در یک فروشگاه شلوغ، به جای اینکه یک صندوقدار سریعتر استخدام کنید، صندوقهای بیشتری باز میکنید تا مشتریان در صفهای مختلف پخش شوند. این رویکرد برای معماریهای مدرن مانند میکروسرویسها و سیستمهای توزیعشده که میتوانند به راحتی روی چندین ماشین اجرا شوند، ایدهآل است.

- مقیاسپذیری عمودی (Vertical Scaling / Scale-Up): این روش بر افزایش ظرفیت یک سرور واحد تمرکز دارد؛ یعنی افزودن منابعی مانند CPU، RAM یا فضای ذخیرهسازی به یک ماشین موجود. با استفاده از همان مثال فروشگاه، این رویکرد مانند استخدام یک صندوقدار سریعتر و کارآمدتر است که میتواند به تنهایی مشتریان بیشتری را مدیریت کند. این روش برای برنامههای یکپارچه (Monolithic) و پایگاههای داده که به سادگی قابل توزیع نیستند، کاربرد بیشتری دارد.

جدول زیر این دو رویکرد را با جزئیات بیشتری مقایسه میکند:

| ویژگی | مقیاسپذیری افقی (Scale-Out) | مقیاسپذیری عمودی (Scale-Up) |

| رویکرد | افزودن یا حذف سرورهای بیشتر | افزایش منابع (CPU, RAM) یک سرور واحد |

| موارد استفاده | میکروسرویسها، سیستمهای توزیعشده، وبسرورها | پایگاههای داده رابطهای، برنامههای Legacy و یکپارچه |

| تحمل خطا | بالا؛ خرابی یک سرور بر کل سیستم تأثیر نمیگذارد | پایین؛ خرابی سرور واحد به معنای از دسترس خارج شدن کل سرویس است |

| پیچیدگی پیادهسازی | پیچیدهتر؛ نیازمند Load Balancer و معماری توزیعشده است | سادهتر؛ معمولاً با یک درخواست ارتقا و راهاندازی مجدد سرور انجام میشود |

| هزینهها | برای مقیاسهای بزرگ مقرونبهصرفهتر است | در ابتدا ارزانتر، اما هزینهی سرورهای بسیار قدرتمند به سرعت افزایش مییابد |

| محدودیت | تقریباً نامحدود؛ میتوان سرورهای زیادی اضافه کرد | محدود به حداکثر ظرفیت سختافزاری یک سرور واحد |

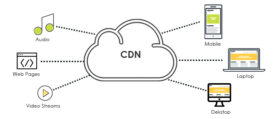

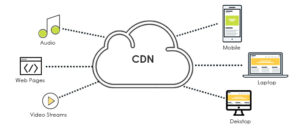

۱.۲. تفاوت Auto Scaling با Load Balancing

اغلب دو مفهوم Auto Scaling و Load Balancing با یکدیگر اشتباه گرفته میشوند، در حالی که نقشهای مکملی دارند.

- Load Balancing (متعادلسازی بار): وظیفه آن توزیع ترافیک ورودی بین سرورهای موجود در یک مجموعه است. هدف اصلی آن جلوگیری از فشار بیش از حد روی یک سرور و اطمینان از پاسخگویی سریع است. اگر یک سرور از دسترس خارج شود، Load Balancer به طور خودکار ترافیک را به سرورهای سالم هدایت میکند.

- Auto Scaling (مقیاسپذیری خودکار): وظیفه آن تغییر تعداد سرورها بر اساس تقاضای واقعی است. زمانی که Load Balancer تشخیص دهد که سرورهای موجود تحت فشار زیادی هستند (مثلاً CPU همهی آنها بالاست)، Auto Scaling وارد عمل شده و سرورهای جدیدی را به مجموعه اضافه میکند. برعکس، وقتی ترافیک کم میشود، سرورهای اضافی را حذف میکند تا از هزینههای غیرضروری جلوگیری شود.

در عمل، این دو تکنولوژی برای دستیابی به یک زیرساخت پایدار و کارآمد، همیشه با یکدیگر به کار میروند. Load Balancer بار را مدیریت میکند و Auto Scaling ظرفیت را.

حال که با اصول اولیه آشنا شدیم، در بخش بعدی روشهای مختلف پیادهسازی Auto Scaling را بررسی خواهیم کرد.

۲. رویکردهای پیادهسازی Auto Scaling

Auto Scaling یک راهکار یکسان برای همه نیست. سازمانها میتوانند بر اساس ماهیت بار کاری، الگوهای ترافیکی و اهداف کسبوکار خود، رویکردهای مختلفی را برای پیادهسازی آن به کار گیرند. انتخاب رویکرد مناسب، کلید دستیابی به تعادل میان عملکرد، هزینه و پایداری است.

انواع روشهای مقیاسپذیری خودکار

سه روش اصلی برای اجرای Auto Scaling وجود دارد که در ادامه به تشریح آنها میپردازیم:

- مقیاسپذیری پویا یا واکنشی (Dynamic/Reactive Scaling): این رایجترین و شناختهشدهترین روش است. در این رویکرد، سیستم به صورت آنی به تغییرات در معیارهای عملکردی (Metrics) مانند میانگین استفاده از CPU، تعداد درخواستها در صف یا پهنای باند شبکه واکنش نشان میدهد. برای مثال، میتوان یک قانون تعریف کرد که اگر میانگین استفاده از CPU در گروه سرورها برای ۵ دقیقه از ۷۰٪ فراتر رفت، یک سرور جدید اضافه شود. برای جلوگیری از نوسانات شدید و واکنشهای بیش از حد (مانند اضافه و کم کردن سریع سرورها)، از مکانیزمی به نام «دوره خنک شدن» (Cooldown Period) استفاده میشود که پس از هر تغییر، سیستم برای مدتی از انجام تغییرات جدید خودداری میکند.

- مقیاسپذیری زمانبندیشده (Scheduled Scaling): این روش برای بارهای کاری با الگوهای قابل پیشبینی ایدهآل است. اگر کسبوکار شما میداند که ترافیک در ساعات مشخصی از روز (مانند ساعات کاری)، روزهای خاصی از هفته (مانند آخر هفتهها برای سرویسهای سرگرمی) یا در مناسبتهای ویژه (مانند تخفیفهای فصلی) افزایش مییابد، میتواند منابع را در زمانهای از پیش تعیینشده افزایش یا کاهش دهد. این رویکرد بسیار کارآمد و کمهزینه است، زیرا منابع دقیقاً زمانی که مورد نیاز هستند آماده میشوند و از واکنشهای تأخیری جلوگیری میکند.

- مقیاسپذیری پیشبینانه (Predictive Scaling): این پیشرفتهترین رویکرد است که با استفاده از الگوریتمهای یادگیری ماشین (Machine Learning) و تحلیل دادههای عملکردی تاریخی، نیازهای آینده به منابع را پیشبینی میکند. به جای واکنش به وضعیت فعلی، این سیستم تلاش میکند تا قبل از وقوع افزایش تقاضا، ظرفیت لازم را فراهم کند. برای مثال، AWS این قابلیت را ارائه میدهد که الگوهای ترافیکی را تحلیل کرده و منابع را از قبل آماده میکند. شرکت Netflix نیز از یک موتور پیشبینانه قدرتمند به نام

Scryerبرای مدیریت بهینه ظرفیت عظیم زیرساخت خود استفاده میکند تا تجربهای بینقص را برای میلیونها کاربر خود در سراسر جهان فراهم آورد.

انتخاب روش مناسب به شناخت دقیق الگوهای بار کاری شما بستگی دارد که در بخش بعدی به آن خواهیم پرداخت.

۳. چه زمانی باید از Auto Scaling استفاده کرد؟ (موارد کاربرد کلیدی)

ارزش واقعی Auto Scaling زمانی مشخص میشود که به درستی برای بارهای کاری مناسب به کار گرفته شود. همه برنامهها از مقیاسپذیری خودکار به یک اندازه سود نمیبرند. شناسایی الگوی صحیح بار کاری، یک تصمیم معماری کلیدی است که مستقیماً بر تعادل میان هزینه، عملکرد و پایداری تأثیر میگذارد. کلید موفقیت در این است که الگوهای ترافیکی و نیازمندیهای عملکردی سرویس خود را به خوبی بشناسید تا بتوانید استراتژی مقیاسپذیری صحیحی را انتخاب کنید.

۳.۱. شناسایی الگوهای بار کاری

تحقیقات آکادمیک بر روی بارهای کاری سرورلس نشان میدهد که ترافیک سرویسها معمولاً از چهار الگوی اصلی پیروی میکند. شناسایی و تنظیم استراتژی Auto Scaling بر اساس این الگوها، اثربخشی آن را به شدت افزایش میدهد:

- SPIKE (جهش ناگهانی): این الگو مربوط به افزایش ناگهانی و غیرمنتظره ترافیک است، مانند زمانی که یک محتوا ویروسی میشود. برای مدیریت مؤثر این الگو، استراتژی باید تهاجمی باشد. این شامل استفاده از مقیاسپذیری پیشبینانه، آمادهسازی منابع از قبل (pre-warming instances یا warm pools) و تنظیم یک هدف CPU پایین (مانند ۳۰٪) است تا ظرفیت کافی برای پاسخگویی فوری به جهش ترافیک وجود داشته باشد و از نقض توافقنامه سطح خدمات (SLO) جلوگیری شود.

- PERIODIC (دورهای): این الگو شامل بارهای کاری با چرخههای منظم و قابل پیشبینی است، مانند سیستمهای گزارشگیری شبانه. در این حالت، مقیاسپذیری زمانبندیشده (Scheduled Scaling) کارآمدترین راهکار است. برای بهینهسازی بیشتر، میتوان آن را با یک مدل پیشبینی (مانند Holt-Winters) ترکیب کرد و یک هدف CPU بالاتر (مانند ۷۵٪) تنظیم نمود، زیرا بار کاری قابل پیشبینی است و نیازی به حاشیه اطمینان بزرگ نیست.

- RAMP (رشد تدریجی): این الگو زمانی رخ میدهد که بار کاری به تدریج در حال افزایش است، مانند مراحل رشد یک سرویس جدید. بهترین استراتژی در اینجا، یک رویکرد مقیاسپذیری پویا است که روند رشد را دنبال میکند. تنظیم یک هدف CPU متوسط (مانند ۶۰٪) به سیستم اجازه میدهد تا به صورت تدریجی و همگام با رشد تقاضا، منابع را افزایش دهد.

- STATIONARY (پایدار): این الگو به سرویسهایی با بار کاری ثابت و نوسانات کم اشاره دارد، مانند سرویسهای پسزمینه. در این سناریو، یک استراتژی محافظهکارانه کافی است. استفاده از

Horizontal Pod Autoscaler (HPA)با یک آستانه CPU پایدار (مانند ۵۵٪)، نیاز سیستم را بدون ایجاد هزینههای اضافی تأمین میکند.

۳.۲. مثالهای کاربردی در صنایع مختلف

کاربردهای عملی Auto Scaling در صنایع مختلف به وضوح دیده میشود:

- تجارت الکترونیک: وبسایتهای فروشگاهی در زمان تخفیفهای بزرگ مانند «جمعه سیاه» با جهشهای عظیم ترافیک مواجه میشوند. Auto Scaling به آنها کمک میکند تا ظرفیت سرورها را به طور خودکار افزایش داده و پس از پایان کمپین، منابع را به حالت عادی بازگردانند.

- بازیهای آنلاین: تعداد بازیکنان در یک بازی آنلاین در طول روز و به خصوص در آخر هفتهها نوسانات زیادی دارد. سرورهای بازی با استفاده از Auto Scaling میتوانند ظرفیت خود را بر اساس تعداد بازیکنان فعال تنظیم کنند تا تجربهای روان و بدون تأخیر برای همه فراهم شود.

- تبلیغات دیجیتال: در طول کمپینهای تبلیغاتی بزرگ، سیستمهای پردازش و تحلیل داده با حجم عظیمی از اطلاعات مواجه میشوند. Auto Scaling به این سیستمها اجازه میدهد تا منابع پردازشی خود را در زمان اوج کمپین افزایش داده و پس از آن کاهش دهند تا هزینهها بهینه شوند.

اگرچه Auto Scaling ابزاری قدرتمند است، اما پیادهسازی موفق آن نیازمند شناخت دقیق سیستم و رعایت بهترین شیوههاست که در بخش نهایی به آنها خواهیم پرداخت.

۴. بهترین شیوهها و نکات کلیدی برای پیادهسازی Auto Scaling

پیادهسازی Auto Scaling بدون برنامهریزی دقیق میتواند نتایج معکوس به همراه داشته باشد و منجر به افزایش غیرمنتظره هزینهها یا عملکرد ضعیف سیستم شود. بنابراین، رعایت مجموعهای از بهترین شیوهها برای دستیابی به یک زیرساخت مقیاسپذیر، پایدار و مقرونبهصرفه ضروری است.

اجتناب از اشتباهات رایج

برای پیادهسازی موفق Auto Scaling، از اشتباهات رایج زیر و راهحلهای آنها آگاه باشید:

- پیکربندی متریکهای صحیح: اشتباه: اتکا صرف به معیار استفاده از CPU میتواند گمراهکننده باشد. برنامهای ممکن است به دلیل محدودیت حافظه (RAM) یا صف طولانی درخواستها دچار مشکل شود، در حالی که CPU آن بیکار است. راهحل: از متریکهای سفارشی (Custom Metrics) که مستقیماً عملکرد برنامه را نشان میدهند (مانند زمان پاسخدهی یا تعداد پیامها در صف) استفاده کنید. فرآیند آن شامل پیکربندی این متریکها در یک سرویس مانیتورینگ (مانند AWS CloudWatch) و سپس ایجاد سیاستهای مقیاسپذیری بر اساس آنها است.

- تنظیم محدودیتهای حداقل و حداکثر: اشتباه: عدم تعریف حداقل (min) و حداکثر (max) تعداد سرور. راهحل: همیشه

minرا برای تضمین حداقل ظرفیت وmaxرا به عنوان یک اقدام ایمنی برای جلوگیری از هزینههای سرسامآور در صورت بروز خطا یا حمله تعیین کنید. ابزارهایی مانند AWS Trusted Advisor میتوانند برای تعیین محدودیتهای بهینه، پیشنهاداتی ارائه دهند. - در نظر گرفتن زمان آمادهسازی (Warm-Up Time): اشتباه: نادیده گرفتن زمانی که یک سرور جدید برای بارگذاری برنامه و عملیاتی شدن کامل نیاز دارد. این کار میتواند منجر به مقیاسپذیری زودهنگام و بیثبات شود. راهحل: از ابزارهایی مانند AWS Auto Scaling Lifecycle Hooks استفاده کنید تا اقدامات مقیاسپذیری را تا زمانی که یک سرور کاملاً آماده شود به تأخیر بیندازید. همچنین، مقیاسپذیری پیشبینانه ذاتاً این زمان را در محاسبات خود لحاظ میکند.

- تنظیم صحیح دورههای خنک شدن (Cooldown Periods): اشتباه: تعریف نکردن یا تنظیم نادرست دوره خنک شدن. راهحل: پس از هر عملیات مقیاسپذیری، یک دوره خنک شدن تعریف کنید تا از نوسانات سریع و غیرضروری (افزایش و کاهش پیدرپی منابع) جلوگیری کرده و به سیستم فرصت دهید تا به حالت پایدار برسد.

- پرهیز از مقیاسپذیری بیش از حد تهاجمی: اشتباه: تنظیم سیاستهایی که با کوچکترین تغییر، منابع را به شدت افزایش میدهند. راهحل: مقیاسپذیری سریع همیشه بهترین راه نیست و میتواند منجر به افزایش بیرویه هزینهها شود. استراتژی خود را طوری تنظیم کنید که تعادلی بین عملکرد و هزینه برقرار شود و همیشه عملکرد سیستم را پس از اعمال تغییرات نظارت کنید.

نقش معماری مدرن: میکروسرویس و کانتینر

اثربخشی Auto Scaling در معماریهای مدرن دوچندان میشود. این معماریها ذاتاً برای مقیاسپذیری طراحی شدهاند:

- طراحی ماژولار (میکروسرویسها): به جای یک برنامه یکپارچه و بزرگ (Monolithic)، معماری میکروسرویس برنامه را به اجزای کوچک و مستقل تقسیم میکند. این ساختار ماژولار به شما اجازه میدهد تا هر بخش از برنامه را به صورت مستقل مقیاسبندی کنید. این رویکرد بسیار کارآمدتر و کمهزینهتر است.

- کانتینریسازی (Docker و Kubernetes): ابزارهایی مانند Docker برای بستهبندی برنامهها و Kubernetes برای مدیریت آنها، پیادهسازی Auto Scaling را بسیار ساده و خودکار میکنند. کوبرنتیز با قابلیتهایی مانند

Horizontal Pod Autoscaler (HPA)میتواند به طور خودکار تعداد کانتینرهای (Pod) در حال اجرای یک سرویس را بر اساس معیارهای تعریفشده تنظیم کند. این امر مقیاسپذیری افقی را به یک فرآیند کاملاً خودکار و هوشمند تبدیل میکند.

۵. جمعبندی

در این مقاله، به بررسی مفهوم Auto Scaling، مکانیسمهای عملکردی و رویکردهای مختلف پیادهسازی آن پرداختیم. همانطور که دیدیم، Auto Scaling دیگر یک قابلیت لوکس نیست، بلکه یک ضرورت استراتژیک برای کسبوکارهای مدرن است که به دنبال ساخت زیرساختهای ابری کارآمد، پایدار و مقرونبهصرفه هستند. با انتخاب استراتژی مناسب بر اساس الگوهای بار کاری و رعایت بهترین شیوهها، سازمانها میتوانند از سه مزیت کلیدی این فناوری بهرهمند شوند:

- بهینهسازی هزینهها: با تطبیق دقیق منابع با تقاضای واقعی، از پرداخت هزینههای اضافی برای منابع بیکار جلوگیری میشود (پرداخت فقط به اندازه مصرف).

- افزایش پایداری و اطمینان: سرویسها حتی در زمان اوج بار و جهشهای غیرمنتظره ترافیک، در دسترس و پاسخگو باقی میمانند.

- بهبود تجربه کاربری: با کاهش تأخیر و تضمین عملکرد پایدار، رضایت و وفاداری کاربران نهایی افزایش مییابد.

در نهایت، Auto Scaling از یک ابزار فنی فراتر رفته و به یک قابلیت استراتژیک تبدیل میشود که مرز بین زیرساختهای واکنشی و معماریهای ابر-بومیِ آیندهنگر را مشخص میکند.