در اکوسیستم مدرن رایانش ابری، مدیریت منابع فراتر از یک وظیفه عملیاتی، به یک «ضرورت استراتژیک» برای بقای کسبوکار تبدیل شده است. نوسانات تقاضا در پلتفرمهای دیجیتال چنان آنی و شدید است که تکیه بر زیرساختهای ایستا (Static)، معادل پذیرش ریسک شکست در لحظات کلیدی تجارت است. Auto Scaling به عنوان موتور هوشمند پایداری، با برقراری توازن میان عملکرد (Performance) و هزینههای عملیاتی، زیرساخت را از یک هزینه ثابت به یک دارایی پویا تبدیل میکند که قادر است همگام با نبض بازار تغییر شکل دهد.

۱. مبانی و ماهیت Auto Scaling در رایانش ابری

مقیاسپذیری خودکار یا Auto Scaling، توانایی یک سیستم ابری برای تخصیص یا آزادسازی هوشمند منابع محاسباتی (CPU، حافظه و پهنای باند) بر اساس تقاضای واقعی در لحظه است. هدف غایی، اطمینان از این است که سیستم همواره در «نقطه بهینه» فعالیت میکند؛ یعنی نه دچار کمبود منابع (Under-provisioning) میشود که منجر به کندی گردد و نه دچار هدررفت منابع (Over-provisioning) که هزینههای گزاف به بار آورد.

اجزای کلیدی و مکانیزم عملیاتی

برای پیادهسازی این فناوری، چهار رکن فنی باید با دقت پیکربندی شوند:

- گروههای مقیاسدهی (Auto Scaling Groups – ASGs): واحد منطقی شامل مجموعهای از منابع (مانند نمونههای EC2) که به صورت یکپارچه مدیریت میشوند.

- الگوهای راهاندازی (Launch Templates): بلوپرینتهای پیکربندی شامل نوع سیستمعامل، نقشهای امنیتی و نوع سختافزار که به سیستم میگوید هر منبع جدید چگونه باید ساخته شود.

- سیاستهای مقیاسدهی (Scaling Policies): قوانین تصمیمگیرندهای که شرایط را مشخص میکنند (مثلاً: «افزودن دو نود در صورت عبور مصرف CPU از ۸۰٪ برای ۵ دقیقه»).

- متریکهای پایش (Monitoring Metrics): دادههای زنده از ابزارهایی مانند CloudWatch که ورودیهای لازم را برای اجرای سیاستها فراهم میکنند.

نکته استراتژیک: هرچند اتوماسیون باعث حذف خطاهای انسانی و جلوگیری از فرسودگی تیمهای SRE میشود، اما به عنوان یک معمار ارشد معتقدم «مقیاسدهی دستی» (Manual Scaling) نباید کاملاً حذف شود. این روش همچنان به عنوان یک لایه کنترلی ضروری برای مراحل دیباگینگ، تستهای اولیه و شرایط پیشبینینشدهای که مدلهای خودکار برای آن آموزش ندیدهاند، جایگاه خود را حفظ کرده است.

——————————————————————————–

۲. کالبدشکافی انواع مقیاسدهی: افقی، عمودی و مورب

انتخاب جهت مقیاسدهی، مستقیماً به معماری اپلیکیشن و لایه داده (Data Layer) بستگی دارد.

مقایسه تطبیقی متدولوژیها

| پارامتر مقایسه | مقیاسبندی افقی (Scaling Out/In) | مقیاسبندی عمودی (Scaling Up/Down) |

| نحوه اجرا | افزودن یا حذف ماشینهای جدید به کلاستر | افزایش RAM/CPU در یک ماشین واحد موجود |

| محدودیت سختافزاری | عملاً نامحدود (توزیع بار بین بینهایت نود) | محدود به حداکثر ظرفیت سختافزاری یک سرور |

| نیاز به Downtime | صفر (به دلیل ماهیت توزیعشده) | معمولاً نیازمند راهاندازی مجدد (Restart) است |

| چالش دیتابیس | هزینه بالای اشتراک داده به دلیل فقدان فضای آدرس مشترک | مناسب برای دیتابیسهای سنتی (MySQL/SQL) |

| مثالهای رایج | Cassandra, MongoDB, NoSQL | RDS, Oracle, SQL Server |

مقیاسبندی مورب (Diagonal) و ملاحظات فنی

در مقیاسبندی مورب، سیستم همزمان با افزایش منابع داخلی سرورها، تعداد آنها را نیز افزایش میدهد تا حداکثر انعطافپذیری حاصل شود. با این حال، در لایه دادههای توزیعشده، چالشهای جدی وجود دارد. به عنوان مثال، در پردازش گرافهای بزرگ با استفاده از ابزارهایی نظیر iGraph، مقیاسدهی افقی با چالش «پارتیشنبندی گراف» روبروست؛ جایی که توزیع نابرابر یالها و گرهها میتواند منجر به گلوگاههای پردازشی شود.

——————————————————————————–

۳. پارادایمهای تصمیمگیری و مدلهای ریاضی در Auto Scaling

انتقال از مدلهای واکنشی به پیشبینانه، مرز بین یک معماری ایستا و یک زیرساخت هوشمند است.

- Dynamic Scaling (پویا): واکنشی (Reactive) است و بر اساس متریکهای لحظهای عمل میکند. در این لایه، مفهوم Cooldown Period (زمان خنکسازی) حیاتی است؛ سیستم باید پس از هر عملیات مقیاسدهی مدتی صبر کند تا اثر تغییرات مشاهده شود و از نوسانات شدید (Thrashing) جلوگیری گردد.

- Predictive Scaling (پیشبینانه): این مدل از یادگیری ماشین و متدولوژیهای علمی مانند Queuing Theory (تئوری صف) و MDP (فرآیند تصمیمگیری مارکوف) برای پیشبینی الگوهای ترافیکی استفاده میکند تا منابع را قبل از وقوع پیک (مثلاً شروع یک مسابقه فوتبال یا جشنواره فروش) آماده کند.

- Scheduled Scaling (زمانبندی شده): برای بارهای کاری کاملاً شناخته شده (مانند خاموش کردن نودهای تست در شب) استفاده میشود.

تحلیل معمار: ترکیب مدلهای Predictive (برای آمادگی اولیه) و Dynamic (برای پاسخ به نوسانات لحظهای پیشبینینشده) به همراه مدیریت دقیق Cooldown، بهینهترین حالت عملکردی را تضمین میکند.

——————————————————————————–

۴. سناریوهای کاربردی و تحلیل صنایع هدف

- تجارت الکترونیک: مدیریت جهشهای ناگهانی در جشنوارههای خرید بدون از دست رفتن نشستهای (Sessions) مشتریان.

- صنعت بازی (Gaming): تنظیم ظرفیت سرورها بر اساس تعداد گیمرهای آنلاین در مناطق جغرافیایی مختلف.

- سلامت (Healthcare): در سیستمهای پایش علائم حیاتی، Auto Scaling برای جلوگیری از تأخیر در پردازش سیگنالهای حساس (مانند نوار قلب – ECG) حیاتی است؛ چرا که تأخیر چند ثانیهای در ارسال دادهها میتواند با جان بیمار در ارتباط باشد.

- مخابرات (Telco Cloud): مدیریت زیرساختهای 5G از طریق مقیاسدهی عملکردهای مجازی و کانتینری شبکه (VNFs/CNFs) برای تضمین پایداری ارتباطات در مقیاس وسیع.

——————————————————————————–

۵. چالشها، محدودیتها و استراتژیهای FinOps

بدون نظارت دقیق، Auto Scaling میتواند به یک «تله هزینهای» تبدیل شود. گزارشها نشان میدهد سازمانهایی که به ابر مهاجرت میکنند حدود ۳۲٪ از بودجه خود را به دلیل عدم بهینهسازی منابع هدر میدهند.

ریسکهای عملیاتی و طراحی Stateless

بزرگترین چالش فنی، اپلیکیشنهایی هستند که دارای Shared States (وضعیت مشترک) یا Session Affinity (چسبندگی نشست) هستند. اگر اپلیکیشن به صورت Stateless طراحی نشده باشد، Auto Scaling باعث قطع شدن نشستهای کاربران و اختلال در عملکرد میشود. معماران باید اپلیکیشنهای میرا (Legacy) را پیش از پیادهسازی مقیاسدهی خودکار، تحت بازطراحی (Refactoring) قرار دهند.

بهینهسازی هزینه و انرژی

- Spot Instances: استفاده از «ظرفیت مازاد» ابر با قیمت بسیار پایین برای بارهای کاری انعطافپذیر.

- بهرهوری انرژی در Hadoop: برای کاهش مصرف انرژی بدون آسیب به پایداری دادهها، باید نودهای ذخیرهسازی (HDFS) را از نودهای محاسباتی (MapReduce) جدا کرد. این کار اجازه میدهد در ساعات کمباری، نودهای محاسباتی خاموش شوند در حالی که نودهای ذخیرهسازی برای حفظ در دسترس بودن دادهها روشن میمانند.

——————————————————————————–

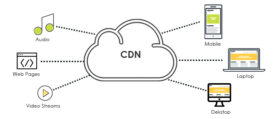

۶. نقش کانتینرسازی و کوبرنتیز در مقیاسپذیری مدرن

کانتینرها به دلیل سرعت بالای بالا آمدن (Spin-up)، مکمل ایدهآل مقیاسپذیری هستند. کوبرنتیز این فرآیند را در دو سطح مدیریت میکند:

- HPA (Horizontal Pod Autoscaler): تنظیم تعداد پادها بر اساس مصرف CPU یا متریکهای سفارشی.

- VPA (Vertical Pod Autoscaler): بهینهسازی منابع تخصیصیافته به هر پاد بر اساس تاریخچه مصرف.

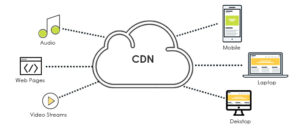

نکته حیاتی FinOps: در کوبرنتیز همواره باید بازههای عددی (Min/Max) برای تعداد پادها و منابع تعیین شود تا از هزینههای انفجاری ناشی از حملات DDoS یا کدهای غیراستاندارد جلوگیری شود. همچنین به یاد داشته باشید که Load Balancer در لایه توزیع ترافیک (Traffic Distribution) عمل میکند، اما Auto Scaling در لایه مدیریت ظرفیت (Capacity Management) قرار دارد؛ این دو بازوان قدرتمند پایداری سیستم هستند.

——————————————————————————–

۷. جمعبندی و توصیههای اجرایی برای مدیران IT

Auto Scaling موتور نامرئی پشت صحنه است که توازن میان سرعت، قابلیت اطمینان و صرفهجویی مالی را برقرار میکند. برای پیادهسازی موفق، این چکلیست نهایی را دنبال کنید:

- پایش مداوم (Monitoring): تنها به CPU بسنده نکنید؛ پهنای باند و نرخ درخواستها را نیز پایش کنید.

- تست در محیط Development: آستانههای مقیاسدهی را با سناریوهای واقعی ترافیک و حجم داده آزمایش کنید.

- مدل ترکیبی: سیاستهای Predictive را با Dynamic ترکیب کنید تا تأخیر در Spin-up نمونهها حذف شود.

- امنیت در مقیاس: از الگوریتمهای تشخیص ترافیک مخرب (Malicious Traffic Detection) استفاده کنید که همگام با افزایش نودها، امنیت آنها را نیز به صورت خودکار پایش کنند.

- طراحی Stateless: اطمینان حاصل کنید که اپلیکیشن شما برای مقیاسدهی افقی طراحی شده و به نشستهای محلی (Local Sessions) وابسته نیست.

با رعایت این اصول، زیرساخت ابری شما نه تنها یک هزینه فنی، بلکه یک مزیت رقابتی پایدار خواهد بود که در تلاطمهای بازار، آرامش و کارایی را برای کسبوکار به ارمغان میآورد.