فهرست مطالب

پادکست استراتژیهای پیشرفته بازیابی فاجعه در سطح شبکه (Network Disaster Recovery)

مقدمه: آناتومی تابآوری در عصر اتصال فراگیر

در اکوسیستم فناوری اطلاعات مدرن، شبکه دیگر تنها یک بستر ارتباطی برای انتقال بستههای داده نیست؛ بلکه به مثابه سیستم عصبی مرکزی سازمان عمل میکند که حیات کسبوکار به تپش مداوم آن وابسته است. بازیابی فاجعه در سطح شبکه (Network Disaster Recovery – NDR) مفهومی است که فراتر از تهیه نسخههای پشتیبان ساده از پیکربندی روترها یا سوئیچها قرار میگیرد. این حوزه، یک دیسیپلین مهندسی پیچیده است که هدف آن تضمین تداوم جریان دادهها و حفظ مسیرهای ارتباطی در مواجهه با طیف وسیعی از تهدیدات فیزیکی، منطقی و سایبری است.1 برخلاف بازیابی فاجعه در لایه اپلیکیشن که بر منطق تجاری تمرکز دارد، یا لایه ذخیرهسازی که بر یکپارچگی بیتها و بایتها متمرکز است، NDR بر “دسترسیپذیری زیرساخت” و “همگرایی مسیرها” استوار است.2 اهمیت این موضوع زمانی روشن میشود که دریابیم بدون یک شبکه فعال، حتی بهترین سیستمهای پشتیبانگیری داده و پایگاههای داده توزیعشده نیز برای کاربران نهایی و سرویسهای وابسته غیرقابل دسترس و عملاً بیفایده خواهند بود.

سازمانهای امروزی با پارادایمهای جدیدی در مدیریت ریسک مواجه هستند. آمارهای صنعت نشان میدهد که هزینه هر ساعت توقف شبکه برای شرکتهای بزرگ میتواند به ارقام نجومی برسد و این تنها شامل زیان مالی مستقیم نیست، بلکه شامل آسیبهای جبرانناپذیر به اعتبار برند و اعتماد مشتریان نیز میشود.3 بنابراین، گذار از مفهوم سنتی “پشتیبانگیری” به مفهوم مدرن “تابآوری سایبرنتیک” ضروری است. در این گزارش تحلیلی، ما به بررسی عمیق معماریها، پروتکلها، و سناریوهای حیاتی طراحی NDR میپردازیم و نشان میدهیم که چگونه همگرایی تکنولوژیهایی مانند SD-WAN، SASE و NetDevOps، چشمانداز بازیابی فاجعه را دگرگون کرده است.

فصل اول: مبانی نظری و متریکهای حیاتی در معماری شبکه

برای طراحی یک سیستم بازیابی فاجعه موثر، ابتدا باید تمایزات ظریف بین مفاهیم بنیادین و متریکهای عملکردی در بستر شبکه را درک کرد. تفاوت بین دسترسپذیری بالا (High Availability – HA) و بازیابی فاجعه (Disaster Recovery – DR) در مقیاس و ماهیت تهدید نهفته است.

تمایز هستیشناختی: HA در برابر DR

در ادبیات مهندسی شبکه، دسترسپذیری بالا (HA) معمولاً به راهکارهایی اطلاق میشود که برای مقابله با خرابیهای localized و جزئی طراحی شدهاند. به عنوان مثال، استفاده از دو منبع تغذیه در یک سوئیچ یا استفاده از پروتکلهایی مانند EtherChannel برای تجمیع لینکها، مکانیزمهای HA هستند که هدفشان پنهان کردن خرابی از دید کاربر نهایی است.1 در مقابل، بازیابی فاجعه (DR) برای سناریوهایی طراحی میشود که در آن مکانیزمهای HA شکست خوردهاند یا دامنه خرابی فراتر از یک دستگاه یا لینک خاص است؛ مانند از دست رفتن کامل یک دیتاسنتر در اثر زلزله یا حمله سایبری گسترده که زیرساخت اصلی را فلج کرده است.2 در حالی که هدف HA به صفر رساندن وقفه است، هدف DR بازگرداندن سرویس در کوتاهترین زمان ممکن پس از یک وقفه اجتنابناپذیر بزرگ است.

تفسیر پیشرفته RTO و RPO در لایه انتقال داده

مفاهیم RTO و RPO که از دنیای ذخیرهسازی وام گرفته شدهاند، در لایه شبکه تفاسیر منحصر به فردی دارند که برای طراحی سناریوها حیاتی هستند.

هدف زمان بازیابی (Recovery Time Objective – RTO):

در شبکه، RTO صرفاً زمان “بالا آمدن” دستگاه نیست، بلکه شامل زنجیرهای از رویدادهاست: تشخیص خرابی (Detection)، انتشار اطلاعات مسیریابی جدید (Propagation)، محاسبه مجدد جداول مسیریابی (Calculation)، و بهروزرسانی جداول فورواردینگ (FIB Update).5

به عنوان مثال، در یک شبکه مبتنی بر BGP، RTO ممکن است تحت تأثیر تایمرهای Keepalive و Hold-time باشد. اگر این تایمرها به درستی تنظیم نشوند، ممکن است تشخیص قطعی لینک تا ۳ دقیقه طول بکشد، که برای سرویسهای VoIP فاجعهبار است. بنابراین، مهندسی RTO در شبکه به معنای مهندسی “زمان همگرایی” (Convergence Time) است.7 کاهش RTO نیازمند استفاده از تکنیکهایی مانند BFD (Bidirectional Forwarding Detection) است که میتواند قطعی را در میلیثانیه تشخیص دهد و پروتکلهای مسیریابی را برای تغییر مسیر تحریک کند.

هدف نقطه بازیابی (Recovery Point Objective – RPO):

در حالی که RPO در ذخیرهسازی به معنای حجم دادههای از دست رفته است، در شبکه به “وضعیت پیکربندی” (Configuration Consistency) و “وضعیت نشستها” (Session State) اشاره دارد.5

- بعد پیکربندی: اگر روتر اصلی بسوزد و روتر جایگزین با فایل پیکربندی متعلق به شش ماه پیش بالا بیاید، تمامی تغییرات امنیتی (ACLs)، تغییرات QoS و روتهای استاتیک جدید از دست میروند. در اینجا RPO فاصله زمانی بین آخرین بکاپ خودکار از کانفیگ و لحظه فاجعه است.

- بعد وضعیت نشست: در فایروالها و Load Balancerها، RPO به همگامسازی جداول State اشاره دارد. اگر فایروال ثانویه اطلاعات نشستهای TCP فعال را نداشته باشد، تمام اتصالات کاربران پس از failover قطع شده و باید دوباره برقرار شوند.9

تحلیل تأثیر کسبوکار (BIA) و طبقهبندی سرویسهای شبکه

طراحی یکپارچه برای تمام سرویسها از نظر اقتصادی و فنی توجیهپذیر نیست. تحلیل تأثیر کسبوکار (BIA) به معماران شبکه اجازه میدهد تا سرویسها را بر اساس حساسیت به تأخیر و قطعی طبقهبندی کنند.10

| لایه سرویس (Tier) | توصیف و مثالها | RTO هدف | معماری شبکه پیشنهادی |

| Tier 0 (حیاتی) | هسته شبکه، DNS، DHCP، اتصال اینترنت دیتاسنتر، لینکهای WAN اصلی | نزدیک به صفر | Active-Active کامل، مسیرهای فیزیکی جداگانه، GSLB |

| Tier 1 (مهم) | اتصال شعب اصلی، VPN دورکاری، سرویسهای مالی | < ۱۵ دقیقه | Active-Passive با failover خودکار (SD-WAN) |

| Tier 2 (کسبوکار) | وایفای داخلی، سیستمهای نظارتی غیرامنیتی | < ۴ ساعت | Active-Passive با مداخله دستی یا اسکریپت |

| Tier 3 (آرشیو) | شبکههای آزمایشی، دسترسی به بکاپهای سرد | < ۲۴ ساعت | Cold Standby (تجهیزات خاموش یا نیاز به نصب) |

این جدول نشان میدهد که برای سرویسهای Tier 0، هزینه بالای لینکهای redundant و تجهیزات اضافی توجیهپذیر است، زیرا هزینه هر ثانیه قطعی بسیار گزاف است.12

فصل دوم: معماریهای استراتژیک سایتهای بازیابی

انتخاب استراتژی سایت بازیابی، بنیادینترین تصمیم در طراحی NDR است که مستقیماً بر بودجه و RTO تأثیر میگذارد. سه مدل اصلی Cold، Warm و Hot وجود دارد که هر کدام دینامیکهای خاص خود را در لایه شبکه دیکته میکنند.

۱. معماری سایت سرد (Cold Site): استراتژی مبتنی بر بازسازی

سایت سرد، فضایی فیزیکی است که دارای زیرساختهای پایه (برق، سرمایش، کابلکشی) است اما فاقد تجهیزات فعال شبکه (روتر، سوئیچ، فایروال) میباشد یا تجهیزات در آن نصب نشدهاند.13

- چالشهای شبکه: در زمان فاجعه، بزرگترین چالش شبکه در سایت سرد، “تأمین و تدارکات” و “بازسازی توپولوژی” است. مهندسان باید تجهیزات را منتقل کرده، Rack & Stack کنند و سپس کابلکشی پچپنلها را انجام دهند.

- مدیریت آدرسدهی: معمولاً در این سناریو، تغییر کامل آدرسهای IP عمومی (Public IP) اجتنابناپذیر است، زیرا سایت سرد در محدوده جغرافیایی و AS (Autonomous System) متفاوتی قرار دارد. این امر مستلزم تغییرات گسترده در DNS جهانی است.14

- کاربرد: مناسب برای آرشیو دادهها و سازمانهایی که میتوانند هفتهها توقف سرویس را تحمل کنند، اما برای اکثر کسبوکارهای مدرن غیرقابل قبول است.15

۲. معماری سایت گرم (Warm Site): تعادل هوشمندانه

سایت گرم دارای تجهیزات شبکه نصب شده و متصل است، اما این تجهیزات در حالت عملیاتی کامل نیستند. لینکهای ارتباطی وجود دارند اما ممکن است پهنای باند کمتری داشته باشند یا در حالت Standby باشند.16

- دینامیک شبکه: در این مدل، روترها و سوئیچها روشن هستند و ممکن است یک پروتکل مسیریابی پایه (مانند OSPF) اجرا کنند تا زندهبودن لینکها را بررسی کنند، اما ترافیک کاربر به سمت آنها هدایت نمیشود. همگامسازی دادهها ممکن است به صورت دورهای (Asynchronous) انجام شود.17

- فرآیند فعالسازی: در زمان فاجعه، نیاز به “Scale-up” کردن پهنای باند (مثلاً از طریق قابلیتهای Bandwidth on Demand در MPLS یا SD-WAN) و تغییر وزنهای BGP برای جذب ترافیک است. RTO در این حالت معمولاً بین چندین ساعت تا یک روز است.18

۳. معماری سایت داغ (Hot Site) و مدل Active-Active

سایت داغ یک کپی آینهای (Mirrored) از سایت اصلی است که در آن تمام تجهیزات شبکه فعال، کانفیگ شده و همگام هستند. در پیشرفتهترین حالت، این منجر به معماری Active-Active میشود.13

- همگامسازی بلادرنگ: لینکهای DCI (Data Center Interconnect) با ظرفیت بالا و تأخیر کم، دو سایت را به هم متصل میکنند تا جداول State فایروالها و پایگاههای داده همگام بمانند.

- مسیریابی هوشمند: شبکه به گونهای طراحی شده که ترافیک به طور خودکار بین دو سایت توزیع میشود. اگر سایت A از دسترس خارج شود، ترافیک به سادگی و بدون دخالت انسانی به سایت B میرود. این امر نیازمند استفاده از تکنولوژیهایی مانند GSLB و Anycast routing است.19

- تحلیل هزینه: این مدل گرانترین گزینه است زیرا نیازمند دو برابر کردن تمام لایسنسها، سختافزارها و هزینههای نگهداری است، اما RTO نزدیک به صفر را تضمین میکند.12

مقایسه تحلیلی متریکهای اقتصادی و فنی

در جدول زیر، مقایسهای جامع بین این سه معماری از منظر زیرساخت شبکه ارائه شده است:

| ویژگی | سایت سرد (Cold) | سایت گرم (Warm) | سایت داغ (Hot) |

| وضعیت تجهیزات شبکه | خاموش/موجود نیست | روشن/Standby | روشن/Active |

| وضعیت لینکهای WAN | غیرفعال | فعال (ظرفیت محدود) | فعال (ظرفیت کامل) |

| همگامسازی پیکربندی | دستی (Backup restore) | دورهای/خودکار | بلادرنگ (Real-time) |

| هزینه عملیاتی (OPEX) | پایین ($) | متوسط ($$) | بسیار بالا ($$$) |

| زمان بازیابی شبکه | روزها/هفتهها | ساعتها | ثانیهها/دقیقهها |

| پیچیدگی فنی | پایین | متوسط | بسیار بالا (نیاز به CI/CD) |

فصل سوم: پروتکلها و تکنولوژیهای توانمندساز در NDR

پیادهسازی سناریوهای DR بدون تسلط بر پروتکلهایی که رفتار ترافیک را کنترل میکنند، غیرممکن است. این بخش به بررسی فنی ابزارهایی میپردازد که “جادوی” failover را ممکن میسازند.

۱. مهندسی ترافیک با BGP و همگرایی سریع

پروتکل BGP (Border Gateway Protocol) زبان اینترنت است و نقش حیاتی در هدایت ترافیک به سمت سایتهای DR ایفا میکند. با این حال، BGP به طور پیشفرض کند است.

- چالش همگرایی: در حالت استاندارد، تشخیص خرابی یک همسایه BGP ممکن است تا ۱۸۰ ثانیه (Hold Timer) طول بکشد. در سناریوی DR، این زمان غیرقابل قبول است.7

- راهکار BFD: پروتکل Bidirectional Forwarding Detection (BFD) یک پروتکل سبک است که سلامت لینک را با ارسال بستههای کنترلی در بازههای میلیثانیهای (مثلاً ۵۰ms) بررسی میکند. با ادغام BFD و BGP، به محض قطع لینک، BFD به BGP اطلاع میدهد و همگرایی در کمتر از یک ثانیه رخ میدهد.22

- دستکاری مسیر (Path Manipulation): برای سناریوهای Active-Passive، از تکنیک AS-Path Prepending استفاده میشود تا مسیر سایت DR طولانیتر و کماولویتتر به نظر برسد. در زمان فاجعه، با حذف این Prepend یا قطع شدن مسیر اصلی، ترافیک به سایت دوم سرازیر میشود.23

۲. تکنولوژیهای SD-WAN: انقلابی در لایه دسترسی

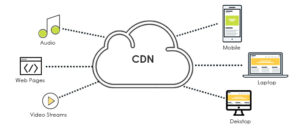

SD-WAN (Software-Defined Wide Area Network) پارادایم DR را از “وابستگی به لینک” به “وابستگی به کیفیت سرویس” تغییر داده است.

- انتزاع سختافزار (Abstraction): SD-WAN چندین لینک فیزیکی (MPLS, LTE, Fiber) را به یک لینک منطقی واحد تبدیل میکند. کنترلر مرکزی بر اساس پالیسیهای تعریف شده تصمیم میگیرد ترافیک را چگونه هدایت کند.3

- مکانیسمهای اصلاح خطا:

- Forward Error Correction (FEC): در شرایطی که لینکها کیفیت پایینی دارند (Packet Loss بالا)، SD-WAN با اضافه کردن بستههای parity به جریان داده، امکان بازسازی بستههای گم شده را در مقصد فراهم میکند. این امر برای حفظ کیفیت VoIP در زمان بحران حیاتی است.25

- Packet Duplication: برای ترافیکهای فوق حیاتی، SD-WAN میتواند کپی بستهها را همزمان از دو مسیر ارسال کند. اولین بستهای که برسد پردازش شده و دومی دور ریخته میشود. این تکنیک “تأثیر قطعی لینک” را به صفر میرساند.27

۳. توازن بار جهانی (GSLB) و نقش DNS

GSLB (Global Server Load Balancing) به عنوان “پلیس ترافیک” در سطح اینترنت عمل میکند.

- مکانیسم: GSLB به طور مداوم سلامت سرویسها (Health Check) را در تمام دیتاسنترها پایش میکند. زمانی که کاربر درخواست DNS برای

www.example.comارسال میکند، GSLB بر اساس سلامت سایتها و موقعیت جغرافیایی کاربر، IP سایت سالم را برمیگرداند.29 - اهمیت TTL: در طراحی DR مبتنی بر DNS، مقدار TTL (Time To Live) رکوردها باید بسیار پایین (مثلاً ۳۰ یا ۶۰ ثانیه) تنظیم شود تا کش DNS کلاینتها و ISPها سریعاً منقضی شده و آدرس IP جدید سایت DR را دریافت کنند.31

۴. پروتکلهای افزونگی هاپ اول (FHRP)

در داخل دیتاسنتر یا شبکه LAN، کلاینتها نیاز به یک Gateway پیشفرض دارند.

- HSRP و VRRP: این پروتکلها (HSRP سیسکو و VRRP استاندارد باز) یک آدرس IP مجازی (VIP) ایجاد میکنند که بین دو یا چند روتر به اشتراک گذاشته میشود. اگر روتر Master از کار بیفتد، روتر Backup در عرض چند ثانیه مسئولیت VIP را بر عهده میگیرد.32

- بهینهسازی: تنظیم تایمرهای Hello به مقادیر میلیثانیه و استفاده از Object Tracking (برای ردیابی وضعیت لینکهای بالادستی) میتواند زمان failover را به حداقل برساند.34

فصل چهارم: سناریوهای حیاتی طراحی بازیابی فاجعه

پاسخ به بخش دوم پرسش کاربر (“چه سناریوهایی باید طراحی شوند؟”) نیازمند تدوین دقیق سناریوهایی است که تمام سطوح خرابی را پوشش دهند. یک استراتژی جامع NDR باید برای پنج سناریوی اصلی زیر طراحی و مستند شود.

سناریو ۱: خرابی تکنقطه در تجهیزات هسته (Core Component Failure)

این محتملترین سناریو است. خرابی منبع تغذیه، سوختن Supervisor Engine در سوئیچ ماژولار، یا خرابی یک Line Card.

- طراحی پیشگیرانه: استفاده از معماریهای بدون نقطه شکست واحد (No Single Point of Failure). استفاده از تکنولوژیهای مجازیسازی شاسی مانند Cisco VSS یا vPC (Virtual Port Channel) که دو سوئیچ فیزیکی را به عنوان یک منطقی نشان میدهند. در این حالت، خرابی یک سوئیچ تنها نیمی از پهنای باند را کاهش میدهد اما ارتباط قطع نمیشود.35

- پاسخ واکنشی: پروتکلهای لایه ۲ (Spanning Tree) و لایه ۳ (OSPF/EIGRP) باید به گونهای تنظیم شوند که مسیرهای جایگزین را از پیش محاسبه کرده باشند (Feasible Successor در EIGRP) تا همگرایی آنی باشد.36

سناریو ۲: قطع کامل ارتباطات و انزوای سایت (Total Link Failure)

سناریوی “بیل مکانیکی” (Backhoe Fade) که در آن تمام فیبرهای فیزیکی ورودی به ساختمان قطع میشوند.

- طراحی: پیادهسازی Diversified Routing. مسیرهای فیزیکی فیبر نوری باید از دو ورودی متفاوت ساختمان و از دو داکت شهری متفاوت عبور کنند. علاوه بر این، استفاده از مدیاهای متفاوت (مثلاً فیبر به عنوان اصلی و مایکروویو/5G به عنوان پشتیبان) ضروری است.9

- چالش فنی: در صورت قطع لینک اصلی، سیستم مانیتورینگ باید بتواند ترافیک را به لینک پشتیبان که ممکن است پهنای باند کمتری داشته باشد (مثلاً 5G)، هدایت کند. در اینجا QoS حیاتی میشود تا ترافیکهای غیرضروری (مانند آپدیت ویندوز) در لینک پشتیبان Drop شوند و ترافیک حیاتی عبور کند.37

سناریو ۳: از دست رفتن کامل دیتاسنتر (Site Failure)

بدترین حالت ممکن: آتشسوزی، سیل، زلزله یا قطع برق سراسری که دیتاسنتر اصلی را کاملاً خاموش میکند.

- طراحی: فعالسازی کامل سایت DR.

- مرحله ۱: GSLB متوجه عدم پاسخگویی سایت اصلی میشود و DNS را به سمت سایت دوم تغییر میدهد.29

- مرحله ۲: BGP در سایت دوم شروع به تبلیغ پیشوندهای IP عمومی میکند (در صورت استفاده از Portable IPs).

- مرحله ۳: کارکنان از طریق VPN به سایت دوم متصل میشوند.

- چالش Split-Brain: اگر تنها لینک بین دو سایت قطع شود اما هر دو سایت سالم باشند، ممکن است هر دو خود را “فعال” فرض کنند. این منجر به ناهماهنگی دادهها میشود. استفاده از یک سایت سوم به عنوان “Witness” یا “Quorum” برای تصمیمگیری در مورد اینکه کدام سایت باید فعال بماند، ضروری است.38

سناریو ۴: حملات سایبری و اشباع سرویس (DDoS & Ransomware)

در این سناریو، زیرساخت سالم است اما به دلیل حجم بالای ترافیک مخرب، غیرقابل استفاده شده است.

- طراحی:

- Scrubbing Centers: هدایت ترافیک ورودی به سرویسهای ابری (مانند Cloudflare یا Akamai) که ترافیک مخرب را فیلتر کرده و ترافیک تمیز را از طریق تونلهای GRE به دیتاسنتر میفرستند.40

- Remotely Triggered Black Hole (RTBH): پیکربندی BGP برای ارسال یک Community خاص به ISP که به آنها دستور میدهد ترافیک ارسالی به IP تحت حمله را در لبه شبکه اینترنت Drop کنند تا لینکهای WAN آزاد شوند.42

- SASE: استفاده از معماری SASE برای اعمال سیاستهای امنیتی در لبه، جایی که کاربران دورکار متصل میشوند، تا از ورود باجافزار به شبکه داخلی در زمان بحران جلوگیری شود.43

سناریو ۵: فساد منطقی و خطای انسانی (Logical Corruption)

بیش از ۷۰٪ خرابیهای شبکه ناشی از خطای انسانی یا باگهای نرمافزاری است (مثلاً اعمال یک ACL اشتباه که دسترسی مدیران را قطع میکند).

- طراحی:

- Network Configuration Management (NCM): سیستمهایی که به طور خودکار از کانفیگها بکاپ میگیرند و تغییرات را ردیابی میکنند (Diff checking).44

- Rollback Automation: قابلیت بازگرداندن سریع تنظیمات به آخرین نسخه پایدار (Last Known Good Configuration) با یک دستور.

- Out-of-Band Management (OOB): داشتن یک شبکه مدیریتی کاملاً جداگانه (مثلاً از طریق مودمهای LTE متصل به پورت کنسول روترها) تا در صورت قطع شبکه اصلی، ادمینها بتوانند وارد تجهیزات شده و مشکل را حل کنند.46

فصل پنجم: عملیاتیسازی DR: تست، اتوماسیون و SASE

داشتن یک طرح روی کاغذ کافی نیست. اعتبار واقعی یک استراتژی NDR در میدان عمل و تحت فشار مشخص میشود.

پارادایم NetDevOps و یکپارچگی CI/CD

رویکرد مدرن به مدیریت شبکه، استفاده از اصول DevOps است. به جای تغییر دستی کانفیگها، تغییرات به صورت کد (Infrastructure as Code) نوشته شده و از طریق خط لولههای CI/CD (Continuous Integration/Continuous Deployment) آزمایش و اعمال میشوند.

- اعتبارسنجی خودکار: قبل از اعمال تغییرات روی روترهای تولید، CI/CD pipeline تغییرات را روی یک محیط شبیهسازی شده (مانند GNS3 یا EVE-NG) تست میکند. اگر تستهای اتصال (Ping check, Routing check) موفق بود، تغییرات اعمال میشوند. این روش احتمال بروز “سناریو ۵” را به شدت کاهش میدهد.47

مهندسی آشوب (Chaos Engineering) در شبکه

تستهای سنتی DR معمولاً برنامهریزی شده و در محیطهای ایزوله انجام میشوند. اما فجایع واقعی خبر نمیکنند. مهندسی آشوب رویکردی است که در آن خرابیها به صورت عمدی و تصادفی به شبکه تولید تزریق میشوند تا تابآوری سیستم سنجیده شود.50

- ابزارها: ابزارهایی مانند Chaos Monkey یا Gremlin میتوانند پورتهای سوئیچ را به صورت تصادفی خاموش کنند، تأخیر شبکه را افزایش دهند یا بستهها را Drop کنند.51

- هدف: کشف وابستگیهای پنهان. مثلاً ممکن است کشف کنید که اگر DNS سرور داخلی قطع شود، سوئیچهای Core به دلیل تلاش برای Resolve کردن نامها در لاگگیری، دچار بار پردازشی بالا (CPU Spike) میشوند.

نقش SASE در بازیابی فاجعه مدرن

معماری Secure Access Service Edge (SASE) همگرایی شبکه و امنیت در فضای ابری است. در سناریوی DR که دیتاسنتر فیزیکی از دسترس خارج میشود، SASE نقشی حیاتی ایفا میکند:

- استقلال از مکان: کاربران برای دسترسی به برنامههای SaaS یا ابری، نیازی به VPN زدن به دیتاسنتر سوخته ندارند. SASE امنیت را در لبه اینترنت تأمین میکند.43

- تداوم کسبوکار: حتی اگر دفتر مرکزی و دیتاسنتر از بین بروند، پالیسیهای امنیتی و دسترسی شبکه که در ابر SASE تعریف شدهاند، پابرجا میمانند و کاربران میتوانند از خانه یا کافه با همان سطح امنیت به کار خود ادامه دهند.54

فصل ششم: فهرست وارسی (Checklist) جامع طرح بازیابی فاجعه

برای اطمینان از آمادگی کامل، سازمانها باید یک سند DRP (Disaster Recovery Plan) زنده داشته باشند که شامل موارد زیر باشد 46:

- زنجیره فرماندهی و ارتباطات: چه کسی فاجعه را اعلام میکند؟ (Disaster Declaration). لیست تماسهای اضطراری شامل وندورها (مانند پشتیبانی سیسکو TAC)، ISPها و تیمهای مدیریت بحران.

- مستندات توپولوژی: نقشههای لایه ۱ (فیزیکی)، لایه ۲ (VLANs, STP) و لایه ۳ (Routing) که باید همیشه بهروز باشند.

- فهرست موجودی (Inventory): لیست دقیق سختافزارها، سریالها، نسخههای IOS/Firmware و لایسنسها برای جایگزینی سریع.

- کتابچه عملیات (Runbook): دستورالعملهای گامبهگام و دقیق برای سناریوهای مختلف (مثلاً: “اگر لینک اصلی قطع شد، دستورات زیر را روی روتر لبه اجرا کنید…”).

- مدیریت دسترسی: اطمینان از اینکه در شرایط اضطراری، ادمینها به پسوردهای دستگاهها (که ممکن است در سرور Tacacs+ داخل دیتاسنتر سوخته ذخیره شده باشد) دسترسی دارند (حسابهای Local Emergency).57

- تست و بازبینی: برنامه زمانبندی شده برای مانورهای دورهای (Drills) و بهروزرسانی طرح بر اساس تغییرات شبکه.

نتیجهگیری

بازیابی فاجعه در سطح شبکه، بیمهنامهای برای حیات دیجیتال سازمان است. تحلیلهای ما نشان داد که تکیه بر روشهای سنتی مانند بکاپهای دستی و سایتهای سرد، دیگر پاسخگوی نیازهای بلادرنگ کسبوکارهای امروزی نیست. همگرایی پروتکلهای هوشمند مانند BGP و SD-WAN با متدولوژیهای نوین مانند NetDevOps و Chaos Engineering، مسیری را برای دستیابی به تابآوری نزدیک به صد در صد هموار کرده است.

معماران شبکه باید DR را نه به عنوان یک “پروژه جانبی”، بلکه به عنوان جزئی جداییناپذیر از طراحی اولیه شبکه ببینند. سرمایهگذاری در افزونگی لینکها، اتوماسیون فرآیندها و تستهای مداوم آشوب، هزینهای گزاف نیست، بلکه سرمایهگذاری برای بقا در لحظاتی است که رقبا به دلیل عدم آمادگی، از صحنه حذف میشوند. در نهایت، بهترین طرح DR طرحی است که آنقدر خوب عمل کند که کاربران نهایی هرگز متوجه وقوع فاجعه نشوند.