۱. مقدمه: عصر جدید تولید محتوا و چالش اصالتسنجی

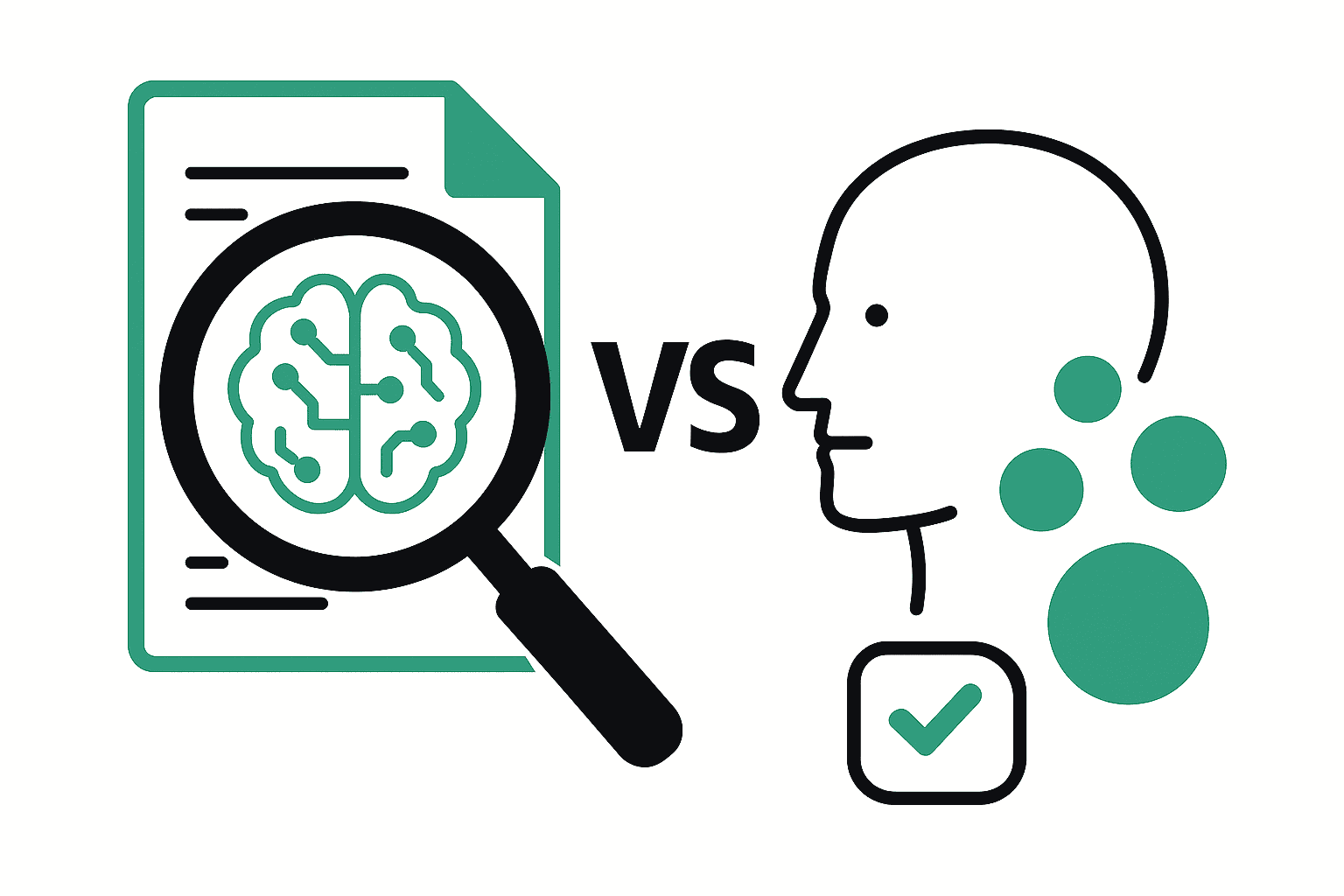

ظهور مدلهای پیشرفته هوش مصنوعی مولد، چشمانداز تولید محتوا را بهطور بنیادین دگرگون کرده است. این فناوری با ارائه سرعتی بیسابقه در خلق متون، پارادایمی جدید را معرفی نموده که ضمن افزایش چشمگیر کارایی، پرسشهای مهمی را در مورد اصالت محتوا و مرز میان نوشتار انسانی و ماشینی مطرح میکند. این تحول، یک بازی فناورانه موش و گربه یا به تعبیری یک «مسابقه تسلیحاتی» میان مدلهای مولد و الگوریتمهای شناساییکننده را به راه انداخته است.

این وایت پیپر به بررسی دقیق همین تنش فزاینده میپردازد: تقابل میان نیاز به تولید محتوای مقیاسپذیر و کارایی روزافزون سیستمهای شناسایی محتوای هوش مصنوعی. در عصری که ابزارهای تشخیص به سرعت در حال پیشرفت هستند، درک راهکارهای موجود برای بهینهسازی فرآیندهای کاری بیش از پیش اهمیت مییابد.

هدف اصلی این سند، ارائه یک تحلیل مبتنی بر شواهد از ابزارهایی است که با عنوان «انسانساز» (Humanizer) شناخته میشوند. ما با استفاده از یک مطالعه موردی مشخص، کارایی این ابزارها را ارزیابی کرده و کاربرد استراتژیک آنها را نه به عنوان ابزاری برای فریب، بلکه به عنوان یک اهرم قدرتمند برای افزایش بهرهوری در زمینههای حرفهای و آکادمیک مورد بحث قرار میدهیم. برای درک کامل ارزش ابزارهای انسانساز، ابتدا باید قابلیتها و محدودیتهای ابزارهای شناسایی هوش مصنوعی را به عنوان پسزمینه این تحلیل بررسی کنیم.

۲. ضرورت شناسایی: چرا تشخیص محتوای هوش مصنوعی اهمیت دارد؟

اهمیت استراتژیک شناسایی محتوای تولیدشده توسط هوش مصنوعی از دیدگاههای حرفهای مختلف قابلبررسی است. بخشهای گوناگون، از بازاریابی دیجیتال گرفته تا محیطهای آکادمیک، به دلایل متفاوتی در تشخیص متنهای ماشینی سرمایهگذاری کردهاند. این تلاشها صرفاً یک واکنش فنی به یک فناوری جدید نیست، بلکه پاسخی به نیازهای عملیاتی، تجاری و اعتباری این حوزههاست.

انگیزههای کلیدی پشت توسعه و بهکارگیری ابزارهای شناسایی هوش مصنوعی ریشه در چند عامل استراتژیک دارد. اولاً، حفظ اعتبار و صدای برند امری حیاتی است. محتوایی که بیش از حد ماشینی به نظر میرسد، میتواند به «دره وهمی محتوا» (Content Uncanny Valley) سقوط کند؛ جایی که متن از نظر دستوری بینقص است اما فاقد گرما و شخصیت انسانی بوده و منجر به قطع ارتباط با مخاطب میشود. ثانیاً، پرهیز از جریمههای موتورهای جستجو یک عامل مهم دیگر است. با بهروزرسانیهایی مانند «محتوای مفید» گوگل (Helpful Content Update)، مرز مشخصی میان محتوای کمکیفیت و تماماً خودکار با محتوای باکیفیتی که با کمک هوش مصنوعی تولید شده، ترسیم شده است. کسبوکارها برای حفظ رتبه خود، نیازمند تضمین کیفیت و اصالت هستند. در نهایت، پاسداری از صداقت علمی در حوزه آکادمیک، تمایز میان ایدههای اصلی پژوهشگر و متنی که صرفاً توسط ماشین پردازش شده را برای حفظ یکپارچگی و اعتبار علمی ضروری میسازد.

ذینفعان اصلی این فرآیند، متخصصان سراسر اکوسیستم محتوای دیجیتال را در بر میگیرند؛ از استراتژیستهای سئو و بازاریابان محتوا گرفته تا پژوهشگران دانشگاهی و متخصصان ارتباطات سازمانی. در ادامه، با یک آزمون عملی، قابلیتهای این ابزارهای شناسایی را به صورت کمی ارزیابی خواهیم کرد تا زمینه برای تحلیل راهکارهای موجود فراهم شود.

۳. مطالعه موردی کمی: آزمون کارایی ابزارهای شناسایی هوش مصنوعی

به منظور سنجش تجربی کارایی ابزارهای پیشرو در زمینه شناسایی هوش مصنوعی، یک مطالعه موردی دقیق طراحی و اجرا شد. هدف از این آزمون، ایجاد یک خط پایه کمی و عینی از توانایی این ابزارها در تشخیص یک نمونه متن تولیدشده توسط هوش مصنوعی بود. این تحلیل، مبنایی برای ارزیابی عملکرد ابزار مداخلهگر انسانساز فراهم میکند.

۳.۱. تشریح روششناسی آزمون

در این آزمایش، مقالهای با موضوع «تأثیر شبکههای اجتماعی بر سلامت روان انسانها» به عنوان متن نمونه انتخاب شد. این محتوا توسط یک مدل زبانی DeepSeek تولید گردید. برای اطمینان از جامعیت نتایج، متن تولیدشده در معرض تحلیل مجموعهای متنوع از پنج ابزار معتبر و شناختهشده در حوزه شناسایی محتوای هوش مصنوعی قرار گرفت:

- Originality.ai

- GPTZero

- Copyleaks

- ZeroGPT

- Winston AI

هر یک از این ابزارها با الگوریتمهای اختصاصی خود، متن را برای یافتن الگوهای مشخصه نوشتار ماشینی اسکن کردند.

۳.۲. تحلیل نتایج اولیه: تشخیص قطعی توسط هوش مصنوعی

نتایج حاصل از اسکن متن خام، نشاندهنده اتفاق نظر قاطع و اطمینان بالای ابزارهای مختلف بود. دادههای زیر نشان میدهند که تمامی پلتفرمها با درصد اطمینان بسیار بالا، متن را به عنوان محتوای ماشینی شناسایی کردند.

نتایج تشخیص محتوای خام هوش مصنوعی | ابزار شناسایی | درصد تشخیص هوش مصنوعی | | :— | :— | | Originality.ai | 100% | | GPTZero | 100% | | Copyleaks | 100% | | ZeroGPT | 96.6% | | Winston AI | 99% |

این یافتهها به وضوح نشان میدهند که ابزارهای مدرن شناسایی، توانایی بالایی در تفکیک محتوای تولیدشده توسط مدلهای زبانی پیشرفته دارند. این سطح بالای تشخیص، چالش اصلی را برای کاربرانی که به دنبال استفاده بهینه از هوش مصنوعی هستند، برجسته میسازد و این پرسش را مطرح میکند: آیا میتوان این تشخیص دقیق را به شیوهای مؤثر مدیریت کرد؟

۴. راهکار مداخله: ارزیابی عملکرد ابزار AI Humanizer

در پاسخ مستقیم به کارایی بالای ابزارهای شناسایی، فناوریهای جدیدی تحت عنوان «انسانساز» (Humanizer) پدید آمدهاند. عملکرد اصلی این ابزارها، بازنویسی و اصلاح متن تولیدشده توسط هوش مصنوعی است تا الگوهای نوشتاری آن به سبک نگارش انسان نزدیکتر شود و از فیلترهای تشخیص عبور کند.

۴.۱. معرفی ابزار و فرآیند انسانسازی

ابزار مورد استفاده در این مطالعه، AI Humanizer است که از طریق وبسایت aihumanizer.ai در دسترس قرار دارد. هدف این ابزار، تبدیل متن ماشینی به فرمتی است که برای خواننده انسانی طبیعیتر به نظر برسد و همزمان توسط الگوریتمهای شناسایی هوش مصنوعی قابلردیابی نباشد. فرآیند کار به این صورت است که متن اولیه تولیدشده توسط هوش مصنوعی به این ابزار داده میشود و خروجی آن، یک متن بازنویسیشده با ویژگیهای انسانیتر است.

۴.۲. تحلیل نتایج پس از انسانسازی: گذار موفق از فیلترهای شناسایی

پس از پردازش متن نمونه توسط ابزار AI Humanizer، نتایج آزمون شناسایی به طرز چشمگیری دگرگون شد. جدول زیر، درصد تشخیص هوش مصنوعی را پس از این مداخله نشان میدهد.

نتایج تشخیص پس از پردازش با AI Humanizer | ابزار شناسایی | درصد تشخیص هوش مصنوعی | | :— | :— | | Originality.ai | 0% (تشخیص به عنوان 100% اصیل) | | GPTZero | 5% | | Copyleaks | 0% | | ZeroGPT | 0% | | Winston AI | 2% (تشخیص به عنوان 98% انسانی) |

این دادهها یک دوگانگی آشکار را با یافتههای اولیه به نمایش میگذارند. اثربخشی عمیق ابزار AI Humanizer در کاهش شدید امتیازات تشخیص هوش مصنوعی در تمام پنج پلتفرم مشهود است. این تغییر چشمگیر نشان میدهد که ابزار AI Humanizer در تغییر نشانگرهای کلیدی زبانی—مانند پیچیدگی (perplexity)، یکنواختی (burstiness) و تنوع ساختار جمله—که الگوریتمهای شناسایی برای تشخیص آنها آموزش دیدهاند، مؤثر عمل میکند. این موفقیت فنی، بحث را از چگونگی عملکرد این ابزارها به چرایی کاربرد استراتژیک و اخلاقی آنها منتقل میکند.

۵. ابعاد استراتژیک: فراتر از گریز از تشخیص، به سوی افزایش بهرهوری

ارزش استراتژیک ابزارهای انسانساز بسیار فراتر از گریز تاکتیکی از سیستمهای شناسایی است؛ ارزش واقعی آنها در تواناییشان برای پیکربندی مجدد جریانهای کاری حرفهای برای به حداکثر رساندن خروجی متخصصان نهفته است. از این منظر، آنها به عنوان دستیارهای نوشتاری هوشمند عمل میکنند که قابلیتهای انسانی را تکمیل و تقویت مینمایند.

برای درک این رویکرد، مثال یک محقق در یک حوزه فنی مانند پردازش تصویر را در نظر بگیرید. تخصص اصلی این فرد در زمینه علمی خود اوست و همانطور که در منبع اشاره شده، او «لزوماً نباید نویسنده خوبی باشد». هدف اصلی چنین متخصصی، انتشار نتایج علمی و نوآوریهایش است. در این سناریو، هوش مصنوعی و ابزارهای انسانساز به عنوان دستیارهای قدرتمند نگارشی عمل میکنند و به محقق کمک میکنند تا یافتههای پیچیده خود را به شکلی واضح و مؤثر بیان کند. این فرآیند به متخصصان اجازه میدهد تا زمان و انرژی خود را بر روی وظایف اصلی خود یعنی تحقیق و نوآوری متمرکز کنند. به بیان دیگر، این ابزارها «زمان را بازتر کرده و دست ما را برای کارهایی که واقعاً مفید هستند، بازتر میکنند».

با این حال، این رویکرد یک چارچوب اخلاقی مستحکم را ایجاب میکند. تمایز میان کاربرد قابلقبول و غیرقابلقبول هوش مصنوعی حیاتی است. استفاده از این فناوری برای کمک به فرآیند نگارش یک امر منطقی و مفید است، اما استفاده از آن برای تولید ایدهها یا دادههای علمی اصلی، اقدامی غیرقابلقبول است. مهمتر از آن، استفاده از دستیارهای هوش مصنوعی مسئولیت متخصص را برای راستیآزمایی افزایش میدهد. همانطور که منبع به درستی اشاره میکند: «حواسمان همیشه باید باشد که فریب مطالب جعلی را نخوریم و همیشه بدانیم منبع کجاست». بنابراین، متخصص انسانی به عنوان داور نهایی کیفیت، دقت و صحت اطلاعات باقی میماند.

۶. نتیجهگیری و چشمانداز آینده

این تحلیل نشان داد که اگرچه ابزارهای شناسایی هوش مصنوعی در تشخیص محتوای ماشینی خام بسیار مؤثر عمل میکنند، اما مطالعه موردی ما به وضوح ثابت کرد که ابزارهای انسانساز مانند AI Humanizer میتوانند به طور قابلاطمینانی از این فیلترها عبور کنند. این یافته، تأییدی بر پویایی مستمر در عرصه فناوریهای زبانی است.

با این حال، تز اصلی این وایت پیپر فراتر از یک تقابل فنی است: ارزش استراتژیک این ابزارها نه در قابلیت پنهانسازی، بلکه در نقش آنها به عنوان افزاینده بهرهوری برای طیف وسیعی از متخصصان نهفته است. برای تولیدکنندگان محتوا، وبلاگنویسان و بهویژه پژوهشگران دانشگاهی، این فناوریها فرصتی برای تمرکز بر تخصص اصلی خود و واگذاری بخشهای زمانبر نگارش به دستیارهای هوشمند فراهم میکنند.

در نهایت، ابزارهای انسانساز را نباید به عنوان یک راه گریز بحثبرانگیز تلقی کرد، بلکه باید آنها را منادی پارادایم جدیدی از همکاری انسان و هوش مصنوعی دانست؛ پارادایمی که در آن، معیار اصلی ارزش محتوا از «نویسندگی» به «تأثیرگذاری» تغییر میکند. این ابزارها بخشی جداییناپذیر از جعبهابزار حرفهای مدرن هستند که به متخصصان کمک میکنند تا تعادلی بهینه میان الزامات کیفیت، اصالت و کارایی در عصر دیجیتال برقرار سازند.