خلاصه مدیریتی

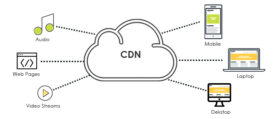

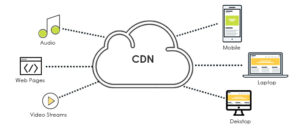

تحلیل منابع متعدد از اواخر سال ۲۰۲۵ نشان میدهد که چشمانداز فناوری توسط چندین روند کلیدی در حال شکلگیری است. هوش مصنوعی (AI) به عنوان نیروی غالب، سرمایهگذاریهای عظیم در زیرساختها را هدایت میکند (مانند سرمایهگذاری ۱۰ میلیارد دلاری آمازون در OpenAI)، در حالی که همزمان سطح حمله را به شدت گسترش داده و چالشهای امنیتی و هزینهای جدیدی ایجاد میکند. در پاسخ به این تحولات، مدلهای رایانش ابری به سمت یک الگوی توزیعشده و «محاسبات در همهجا» در حال تکامل هستند و رایانش لبه (Edge Computing) با استفاده از فناوریهایی مانند Kubernetes و GitOps در حال استانداردسازی است.

در حوزه امنیت سایبری، تمرکز از بهرهبرداری از آسیبپذیریهای نرمافزاری به سمت هدف قرار دادن زیرساختهای با پیکربندی نادرست و سطح حمله گسترده ناشی از هوش مصنوعی تغییر کرده است. همزمان، امنیت دادهها با ظهور «رایانش محرمانه» (Confidential Computing) در حال پیشرفت است تا از دادهها «در حین استفاده» محافظت کند؛ این روند به شدت تحت تأثیر نیازهای پردازشی هوش مصنوعی و مقرراتی مانند EU DORA قرار دارد. در نهایت، با افزایش سرسامآور هزینههای ابری، رشته مدیریت مالی ابری (FinOps) با تمرکز بر اتوماسیون مبتنی بر هوش مصنوعی، مدرنسازی بارهای کاری (مانند مهاجرت به پردازندههای Graviton) و حاکمیت چندابری (از طریق استانداردهایی مانند FOCUS) به بلوغ رسیده است.

——————————————————————————–

تحلیل جامع

۱. هوش مصنوعی به عنوان نیروی محرک اصلی در سرمایهگذاری و ریسک

هوش مصنوعی دیگر یک فناوری نوظهور نیست، بلکه به موتور اصلی سرمایهگذاریهای استراتژیک، نوآوری در زیرساختها و همچنین منبعی برای ریسکهای امنیتی و مالی جدید تبدیل شده است.

سرمایهگذاریهای عظیم در زیرساخت

نیاز سیریناپذیر مدلهای هوش مصنوعی به توان محاسباتی، منجر به سرمایهگذاریهای بیسابقهای شده است. مذاکرات آمازون برای سرمایهگذاری بیش از ۱۰ میلیارد دلاری در OpenAI، که میتواند ارزش این شرکت را به بیش از ۵۰۰ میلیارد دلار برساند، نمونه بارز این روند است. این سرمایهگذاری به OpenAI کمک میکند تا هزینههای هنگفت خود برای محاسبات را بپردازد که طبق گزارشها طی هشت سال آینده به ۱.۴ تریلیون دلار خواهد رسید. این در حالی است که درآمد سالانه این شرکت ۱۳ میلیارد دلار گزارش شده است. این معامله همچنین به OpenAI امکان میدهد تا تعهد ۳۸ میلیارد دلاری خود به خدمات وب آمازون (AWS) را پوشش داده و از تراشههای Trainium آمازون استفاده کند.

در همین راستا، آمازون با ایجاد یک سازمان جدید تحت رهبری پیتر دسانتیس، تمرکز خود را بر توسعه یکپارچه مدلهای هوش مصنوعی (مانند Nova)، سیلیکون سفارشی (Graviton, Trainium) و رایانش کوانتومی افزایش داده است. این اقدام نشاندهنده یک استراتژی عمیق برای کنترل کل زنجیره تأمین هوش مصنوعی، از تراشه تا مدلهای بنیادی است.

پیدایش نئوکلاودها برای پاسخ به تقاضای پردازندههای گرافیکی

کمبود جهانی پردازندههای گرافیکی (GPU) و هزینههای بالای آنها، منجر به ظهور مدل جدیدی به نام «نئوکلاود» (Neocloud) شده است. شرکتهایی مانند CoreWeave، Lambda و Nebius خدمات GPU-as-a-Service ارائه میدهند و به سازمانها اجازه میدهند تا توان محاسباتی با کارایی بالا را به صورت ساعتی اجاره کنند. این مدل که اغلب چندین برابر ارزانتر از ارائهدهندگان ابری بزرگ (Hyperscalers) است، به عنوان یک «دکمه آسان» برای دسترسی به منابع کمیاب GPU عمل کرده و زمان ورود به بازار را برای شرکتهای هوش مصنوعی به شدت کاهش میدهد.

گسترش سطح حمله و چالشهای امنیتی

پذیرش سریع هوش مصنوعی در سطح سازمانی، سطح حمله ابری را به شدت گسترش داده است. بر اساس گزارش Palo Alto Networks:

- ۹۹٪ از سازمانها در سال گذشته حداقل یک حمله علیه برنامهها و خدمات هوش مصنوعی خود را تجربه کردهاند.

- استفاده گسترده از کدنویسی با کمک هوش مصنوعی مولد (GenAI-assisted “vibe coding”) باعث تولید کد ناامن با سرعتی فراتر از توانایی تیمهای امنیتی برای بازبینی شده است.

- حملات API ۴۱٪ افزایش یافته است، زیرا هوش مصنوعی عاملمحور (Agentic AI) به شدت به APIها وابسته است.

- مدیریت هویت و دسترسی (IAM) ضعیف، همچنان به عنوان بزرگترین نقطه ضعف امنیتی شناخته میشود.

چالشهای جدید در بهینهسازی هزینهها

بارهای کاری هوش مصنوعی هزینههای ابری را به شدت افزایش میدهند. طبق گزارش CloudKeeper، ۸۵٪ از پروژههای هوش مصنوعی به دلیل افزایش بیرویه هزینهها و عدم برنامهریزی منابع، به بلوغ نمیرسند. استفاده ناکارآمد از GPUهای گرانقیمت (مانند A100/H100)، عدم بهرهبرداری از Spot Instances و پذیرش پایین جایگزینهای مبتنی بر ARM از جمله دلایل اصلی این هزینههای بالا هستند. این امر نیاز به اعمال اصول FinOps بر روی بارهای کاری هوش مصنوعی را برجسته میکند.

۲. تکامل امنیت سایبری: از آسیبپذیریها به زیرساختها

تهدیدات سایبری در حال تکامل هستند و تمرکز مهاجمان از آسیبپذیریهای نرمافزاری به سمت بهرهبرداری از پیکربندیهای نادرست زیرساختی و پیچیدگیهای محیطهای ابری مدرن تغییر کرده است.

تغییر تاکتیکهای بازیگران دولتی

تیم اطلاعات تهدید آمازون یک کمپین سایبری چندساله (۲۰۲۱-۲۰۲۵) توسط GRU روسیه (شناختهشده به عنوان APT44/Sandworm) را افشا کرد که زیرساختهای حیاتی غربی، به ویژه بخش انرژی را هدف قرار داده بود. نکته قابل توجه در این کمپین، تغییر تاکتیک مهاجمان بود:

- آنها به جای تمرکز بر بهرهبرداری از آسیبپذیریهای روز صفر (Zero-day) یا N-day، به طور فزایندهای دستگاههای لبه شبکه با پیکربندی نادرست (Misconfigured network edge devices) مانند روترها و VPNها را هدف قرار دادند.

- هدف اصلی، جمعآوری اعتبارنامهها (Credential harvesting) در مقیاس بزرگ از طریق شنود ترافیک در لبه شبکه بود.

- زنجیره حمله شامل نفوذ به دستگاه لبه، استفاده از قابلیتهای ضبط بسته (Packet Capture)، استخراج اعتبارنامهها و سپس استفاده از آنها برای نفوذ عمیقتر به شبکههای هدف بود.

امنیت به عنوان یک معماری در لبه شبکه

در محیطهای توزیعشده امروزی که هزاران دستگاه در کارخانهها، انبارها و مکانهای عمومی قرار دارند، دیگر مفهوم «محیط پیرامونی امن» (Perimeter) وجود ندارد. به همین دلیل، مدلهای امنیتی جدیدی مورد نیاز است:

- اعتماد صفر (Zero Trust): هر دستگاه و هر اتصال باید به طور مداوم تأیید هویت شود. هیچ دستگاهی به طور پیشفرض به شبکه اعتماد نمیکند.

- SASE (Secure Access Service Edge): امنیت به جای یک ابزار اضافه، به بخشی از جریان داده تبدیل میشود که هویت، خطمشی و رفتار را به طور مداوم بررسی میکند.

- امضای دیجیتال کانتینرها: برای جلوگیری از حملات در بهروزرسانیهای از راه دور (Over-the-Air)، امضای دیجیتال تصاویر کانتینر برای تأیید صحت و یکپارچگی آنها حیاتی است.

ادغام امنیت ابری و مرکز عملیات امنیت (SOC)

پیچیدگی محیطهای ابری و تعدد ابزارهای امنیتی (به طور متوسط ۱۷ ابزار از ۵ فروشنده مختلف برای هر سازمان) منجر به ایجاد نقاط کور و کندی در واکنش به حوادث شده است. بر اساس نظرسنجیها، ۸۹٪ از سازمانها معتقدند که برای کارایی مؤثر، امنیت ابری و برنامههای کاربردی باید به طور کامل با SOC یکپارچه شوند. این ادغام برای مقابله با تهدیدات سریع و ماشینی که توسط هوش مصنوعی هدایت میشوند، ضروری است.

۳. رایانش توزیعشده: استانداردسازی لبه

مدل «ابر در اولویت» (Cloud First) جای خود را به «محاسبات در همهجا» (Compute Everywhere) داده است. چالش اصلی دیگر اتصال به ابر نیست، بلکه مدیریت کارآمد دهها هزار دستگاه توزیعشده در لبه شبکه است.

Kubernetes به عنوان سیستمعامل لبه

توزیعهای سبک Kubernetes مانند K3s و MicroK8s به استاندارد عملیاتی برای دستگاههای لبه تبدیل شدهاند. این امر به توسعهدهندگان اجازه میدهد تا با دستگاههای لبه مانند مینیسرورها رفتار کرده و از همان خطوط لوله CI/CD که برای خدمات ابری استفاده میکنند، برای استقرار نرمافزار در هزاران دستگاه بهره ببرند. انتشار Kubernetes 1.35 با قابلیت کلیدی «تنظیم منابع Pod در حین اجرا» (In-place Pod Resource Adjustments) این روند را تقویت کرده است. این ویژگی به مدیران اجازه میدهد تا تخصیص CPU و حافظه را بدون نیاز به راهاندازی مجدد Pod تغییر دهند که برای بارهای کاری هوش مصنوعی و محیطهای لبه بسیار حیاتی است.

اتوماسیون در مقیاس با GitOps و AIOps

مدیریت ناوگانهای بزرگ دستگاههای لبه تنها از طریق اتوماسیون پیشرفته امکانپذیر است:

- Zero-Touch Provisioning: دستگاهها به محض اتصال به شبکه، به طور خودکار خود را پیکربندی میکنند.

- Self-Healing & Offline Resilience: دستگاهها میتوانند در صورت قطع شدن شبکه به کار خود ادامه داده، دادهها را به صورت محلی ذخیره کرده و پس از اتصال مجدد، آنها را همگامسازی کنند. سرویسهایی مانند AWS IoT Greengrass این قابلیت را فراهم میکنند.

- GitOps: یک رویکرد مبتنی بر «کشش» (Pull-based) که در آن دستگاهها به طور خودکار آخرین پیکربندی را از یک مخزن Git دریافت و اعمال میکنند و نیاز به بهروزرسانیهای دستی را از بین میبرند.

- AIOps: استفاده از هوش مصنوعی برای نظارت بر سلامت خود ناوگان لبه، پیشبینی خرابیها (مانند فرسودگی حافظه فلش) و بهینهسازی توزیع بارهای کاری بر اساس شرایط شبکه و دستگاه.

۴. پارادایم جدید امنیت داده: رایانش محرمانه

حفاظت از دادهها در حالت سکون (At Rest) و در حال انتقال (In Transit) دیگر کافی نیست. با توجه به نیازهای پردازشی عظیم هوش مصنوعی، حفاظت از دادهها در حین استفاده (In Use) به یک ضرورت استراتژیک تبدیل شده است.

حفاظت از دادهها در حین استفاده

رایانش محرمانه (Confidential Computing) با استفاده از محیطهای اجرایی قابل اعتماد (Trusted Execution Environments – TEEs) مبتنی بر سختافزار، این شکاف امنیتی را پر میکند. TEEها محیطهای ایزولهای در داخل پردازنده ایجاد میکنند که از دسترسی یا تغییر غیرمجاز به کد و دادهها در حین پردازش، حتی از سوی مدیر سیستم یا ارائهدهنده ابر، جلوگیری میکند.

پذیرش سریع با محرکهای رگولاتوری

بر اساس مطالعه IDC در جولای ۲۰۲۵، پذیرش این فناوری به سرعت در حال افزایش است:

- ۷۵٪ از سازمانها در حال استفاده از رایانش محرمانه هستند (۱۸٪ در محیط عملیاتی و ۵۷٪ در حال آزمایش).

- ۷۳٪ از رهبران فناوری اطلاعات با این مفهوم آشنا هستند.

مقرراتی مانند قانون تابآوری عملیاتی دیجیتال اتحادیه اروپا (EU DORA) یکی از اصلیترین محرکهاست. این قانون به صراحت الزام میکند که دادهها در هر سه حالت «سکون، در حال استفاده و در حال انتقال» محافظت شوند. در نتیجه، ۷۷٪ از سازمانها به دلیل وجود DORA، احتمال بیشتری برای پذیرش رایانش محرمانه قائل هستند.

موارد استفاده استراتژیک

رایانش محرمانه فراتر از یک ابزار امنیتی، یک توانمندساز استراتژیک است:

- همکاری امن چندجانبه: سازمانها میتوانند دادهها یا مدلها را بدون افشای اطلاعات خام یا منطق اختصاصی با یکدیگر به اشتراک بگذارند.

- امنسازی چرخه حیات هوش مصنوعی: این فناوری برای حفاظت از الگوریتمها، مدلهای اختصاصی و دادههای حساس در تمام مراحل هوش مصنوعی (از پیشآموزش و آموزش تا استنتاج) یک بهترین رویه محسوب میشود.

- بازنگری در هویت دیجیتال: با استفاده از گواهیدهی (Attestation)، میتوان یک زنجیره اعتماد قابل تأیید از تراشه تا بار کاری و نهادهای مختلف ایجاد کرد.

۵. بلوغ FinOps: مدیریت هزینههای فزاینده ابر

با افزایش پیچیدگی و هزینههای ابری، مدیریت مالی ابری (FinOps) از یک رشته نوظهور به یک ضرورت عملیاتی تبدیل شده است که بر اتوماسیون، مدرنسازی و استانداردسازی متمرکز است.

اتوماسیون و هوش مصنوعی در مدیریت هزینهها

بر اساس گزارش CloudKeeper، رویکردهای مبتنی بر هوش مصنوعی نتایج قابل توجهی به همراه دارند:

- ابزارهای تشخیص ناهنجاری (Anomaly Detection) مبتنی بر هوش مصنوعی میتوانند جهشهای غیرمنتظره در صورتحساب ابری را تا ۲۰٪ کاهش دهند.

- زمانبندی خودکار برای خاموش کردن محیطهای توسعه و آزمایش در ساعات غیرکاری، هزینهها را ۳۰٪ تا ۵۰٪ کاهش میدهد.

- ترکیب ابزارهای هوش مصنوعی با اصلاح انسانی (Human-assisted Remediation) برای تصمیمگیریهای آگاهانه و مبتنی بر زمینه، به عنوان یک استراتژی بسیار مؤثر شناخته میشود.

مدرنسازی بار کاری برای بهرهوری

مهاجرت به معماریهای محاسباتی مدرن یک استراتژی کلیدی برای کاهش هزینههاست:

- مهاجرت به پردازندههای مبتنی بر ARM مانند AWS Graviton میتواند هزینههای محاسباتی را تا ۴۰٪ کاهش دهد. بر اساس دادهها، ۹۰٪ از سازمانها فرصتهایی برای این مهاجرت دارند.

- گذار از ماشینهای مجازی سنتی به کانتینرها و معماریهای بدون سرور (Serverless) باعث کاهش هزینههای عملیاتی و بهبود کارایی میشود.

استانداردسازی و استراتژیهای تعهد چندابری

مدیریت هزینهها در محیطهای چندابری یک چالش بزرگ است. در این زمینه، استاندارد FOCUS (FinOps Open Cost and Usage Specification) به عنوان یک راهحل برای یکسانسازی گزارشدهی هزینهها در بین ارائهدهندگان مختلف ابری (AWS, Azure, GCP) در حال ظهور است. علاوه بر این، استراتژیهای تعهد خرید در حال تکامل هستند. سازمانها از مدلهای ثابت مانند Reserved Instances (RIs) به سمت استراتژیهای انعطافپذیر و مبتنی بر هوش مصنوعی حرکت میکنند که ترکیبی از Savings Plans، Spot Instances و منابع On-Demand را برای به حداکثر رساندن صرفهجویی به کار میگیرند.