عملکرد وبسایت در اکوسیستم دیجیتال مدرن، دیگر صرفاً یک ویژگی فنی جانبی محسوب نمیشود، بلکه به عنوان ستون فقرات تجربه کاربری (UX) و یکی از تعیینکنندهترین عوامل در رتبهبندی موتورهای جستجو (SEO) تثبیت شده است. با معرفی و تثبیت معیارهای Core Web Vitals توسط گوگل، تمرکز از صرفِ سرعت بارگذاری اولیه به سمت معیارهای پیچیدهتری نظیر تعاملپذیری، پایداری بصری و زمان پاسخدهی سرور (TTFB) تغییر یافته است. این گزارش جامع، با رویکردی عمیق و مهندسیمحور، لایههای مختلف پشته تکنولوژی (Tech Stack) را از سطح سیستمعامل و وبسرور گرفته تا لایه پایگاه داده و شبکه توزیع محتوا (CDN) مورد واکاوی قرار میدهد. هدف، ارائه یک نقشه راه دقیق برای معماران سیستم، مهندسان DevOps و مدیران فنی است تا با بهرهگیری از تکنیکهای پیشرفته تیونینگ (Tuning)، بهینهسازی کوئریها و استراتژیهای چندلایه کشینگ، زیرساختی مقیاسپذیر و پاسخگو را بنا نهند که توانایی مدیریت ترافیکهای سنگین را داشته و نرخ تبدیل کسبوکار را به حداکثر برساند.

فهرست مطالب

پادکست بهینهسازی عملکرد سرور برای سئو و تجربه کاربری – جامعترین راهنمای تخصصی

فصل اول: مبانی نظری و معماری پروتکلهای وب مدرن

برای درک عمیق روشهای بهینهسازی، ابتدا باید بستر ارتباطی کلاینت و سرور و تحولات پروتکلهای وب را که تأثیر مستقیمی بر تأخیر (Latency) و پهنای باند دارند، بررسی کرد.

تحول پروتکلها: از HTTP/1.1 تا HTTP/3 و QUIC

در طول دهههای گذشته، پروتکل HTTP دستخوش تغییرات بنیادین شده است. در حالی که HTTP/1.1 با مشکل “انسداد سر خط” (Head-of-Line Blocking) در سطح اپلیکیشن مواجه بود، HTTP/2 با معرفی Multiplexing تلاش کرد تا چندین درخواست را روی یک اتصال TCP واحد ارسال کند. با این حال، HTTP/2 همچنان بر بستر TCP استوار بود و مشکل انسداد سر خط را در لایه انتقال (Transport Layer) حل نکرده بود؛ به این معنا که اگر یک بسته TCP در شبکه گم میشد، تمام استریمهای دیگر نیز تا زمان بازیابی آن بسته متوقف میشدند.

پروتکل HTTP/3 که بر پایه پروتکل انتقال QUIC بنا شده است، پارادایم ارتباطات وب را تغییر داده است. QUIC به جای TCP از پروتکل UDP استفاده میکند که ذاتاً بدون اتصال (Connection-less) است، اما با پیادهسازی مکانیزمهای کنترل ازدحام و قابلیت اطمینان در فضای کاربر (User Space) به جای هسته سیستمعامل، محدودیتهای TCP را دور میزند.

معماری QUIC و حذف Head-of-Line Blocking

یکی از بارزترین مزایای HTTP/3، استقلال استریمهاست. در این معماری، از دست رفتن بستههای مربوط به یک درخواست (مثلاً یک فایل CSS)، تأثیری بر پردازش سایر درخواستها (مثلاً تصاویر یا HTML اصلی) ندارد. مطالعات نشان دادهاند که این ویژگی در شبکههایی با نرخ از دست رفتن بسته (Packet Loss) بالا، مانند شبکههای موبایل یا وایفایهای عمومی شلوغ، عملکرد را به طرز چشمگیری بهبود میبخشد.

علاوه بر این، QUIC فرآیند Handshake را بهینهسازی کرده است. در ترکیب سنتی TCP+TLS، چندین رفت و برگشت (Round Trip) برای برقراری اتصال امن نیاز بود. اما QUIC با ادغام Handshake انتقال و رمزنگاری (TLS 1.3)، زمان برقراری اتصال را به 1-RTT کاهش میدهد و حتی در صورت اتصال مجدد به سرور شناختهشده، از قابلیت 0-RTT پشتیبانی میکند که اجازه میدهد دادهها در اولین بسته ارسالی کلاینت فرستاده شوند.

پیکربندی Nginx برای HTTP/3

برای بهرهبرداری از این مزایا در Nginx، نیاز به استفاده از نسخههای جدید (۱.۲۵ به بالا) و ماژول http_v3_module است. برخلاف پروتکلهای قبلی، فعالسازی HTTP/3 نیازمند تنظیمات خاصی در سطح شبکه و فایروال نیز میباشد، زیرا ترافیک بر بستر UDP و پورت ۴۴۳ جریان مییابد.

Nginx

server {

listen 443 ssl;

listen 443 quic reuseport;

http3 on;

ssl_early_data on;

# هدر Alt-Svc برای آگاهسازی مرورگر از وجود HTTP/3

add_header Alt-Svc 'h3=":443"; ma=86400';

ssl_protocols TLSv1.3;

}

تحلیلها نشان میدهد که پیادهسازی صحیح HTTP/3 میتواند LCP را در کاربرانی که از شبکههای موبایل استفاده میکنند، تا حد قابل توجهی کاهش دهد و تجربه کاربری روانتری را به ارمغان آورد.

معیارهای Core Web Vitals و ارتباط آن با زیرساخت

گوگل با معرفی Core Web Vitals، سه معیار کلیدی را برای سنجش سلامت تجربه کاربری تعیین کرده است که مستقیماً تحت تأثیر عملکرد سرور هستند:

- Largest Contentful Paint (LCP): زمان بارگذاری بزرگترین المان بصری. این معیار وابستگی شدیدی به TTFB (Time to First Byte) دارد. اگر سرور در پردازش درخواست اولیه کند عمل کند، LCP به طور اجتنابناپذیری افزایش مییابد. بهینهسازی دیتابیس، استفاده از کش سمت سرور و CDN، راهکارهای اصلی بهبود LCP هستند.

- Interaction to Next Paint (INP): جایگزین معیار FID شده و پاسخگویی صفحه به تعاملات کاربر را میسنجد. هرچند INP بیشتر متأثر از جاوااسکریپت سمت کلاینت است، اما تأخیر سرور در پاسخ به درخواستهای Fetch/XHR در برنامههای تکصفحهای (SPA) میتواند گلوگاه ایجاد کند.

- Cumulative Layout Shift (CLS): پایداری بصری را میسنجد. اگرچه عمدتاً مربوط به CSS و ابعاد تصاویر است، اما بارگذاری کند فونتها یا تصاویر از سرورهای کند میتواند باعث تغییر چیدمان دیرهنگام شود.

فصل دوم: معماری وبسرور و تنظیمات بنیادین (Nginx vs. Apache)

انتخاب و پیکربندی صحیح وبسرور، نقطه شروع هر استراتژی بهینهسازی است. بحث “Nginx در برابر Apache” سالهاست که مطرح است، اما پاسخ قطعی در درک معماری زیرین هر یک و نحوه مدیریت منابع نهفته است.

تحلیل عمیق معماری Apache HTTP Server

آپاچی به دلیل قدمت و ماژولار بودن، همچنان در بسیاری از محیطها استفاده میشود. معماری آن بر اساس ماژولهای پردازش چندگانه (MPM) بنا شده است که نحوه مدیریت اتصالات شبکه را تعیین میکنند.

گذار از Prefork به MPM Event

در گذشته، ماژول پیشفرض mpm_prefork بود که برای هر درخواست ورودی، یک فرآیند سیستمعامل جداگانه ایجاد میکرد. این روش اگرچه برای ماژولهای غیر thread-safe مانند mod_php قدیمی ضروری بود، اما مقیاسپذیری پایینی داشت. هر فرآیند مقدار قابل توجهی حافظه مصرف میکرد و در ترافیک بالا، سرور با کمبود RAM و در نتیجه Swapping مواجه میشد که قاتل عملکرد است.

در معماری مدرن آپاچی (نسخه ۲.۴ به بالا)، استفاده از MPM Event استاندارد طلایی است. این ماژول ترکیبی از فرآیندها و رشتهها (Threads) را استفاده میکند، اما تفاوت کلیدی آن در مدیریت اتصالات Keep-Alive است. در مدلهای قدیمی، یک فرآیند/رشته تا زمانی که کلاینت اتصال را ببندد مشغول میماند، حتی اگر هیچ دیتایی رد و بدل نشود. اما در MPM Event، یک رشته شنونده (Listener Thread) اختصاصی وجود دارد که اتصالات را مدیریت میکند و تنها زمانی که درخواستی واقعی ارسال شود، کار را به یک رشته کارگر (Worker Thread) میسپارد. این معماری مصرف منابع را در سناریوهای با همزمانی بالا به شدت کاهش میدهد.

تنظیمات حیاتی MPM Event برای مقیاسپذیری

برای دستیابی به حداکثر کارایی در آپاچی، تنظیم دقیق پارامترهای زیر بر اساس منابع سختافزاری ضروری است:

- ServerLimit: سقف تعداد فرآیندهای فرزند فعال را تعیین میکند. این مقدار باید بر اساس کل RAM موجود و میانگین حافظه مصرفی هر فرآیند محاسبه شود تا از “Thrashing Point” (نقطهای که سیستم وارد وضعیت Swap دائمی میشود) جلوگیری گردد.

- ThreadsPerChild: تعداد رشتههای ایجاد شده در هر فرآیند. افزایش این عدد باعث بهرهوری بهتر از حافظه اشتراکی (Shared Memory) میشود، زیرا رشتههای درون یک فرآیند میتوانند کشها را به اشتراک بگذارند. با این حال، در صورت کرش کردن فرآیند، تمام رشتههای آن قطع میشوند. مقدار استاندارد معمولاً ۲۵ است اما در سرورهای قدرتمند میتوان تا ۶۴ افزایش داد.

- MaxRequestWorkers: مهمترین پارامتر که حاصلضرب

ServerLimitدرThreadsPerChildاست و حداکثر تعداد درخواستهای همزمان قابل پردازش را تعیین میکند.

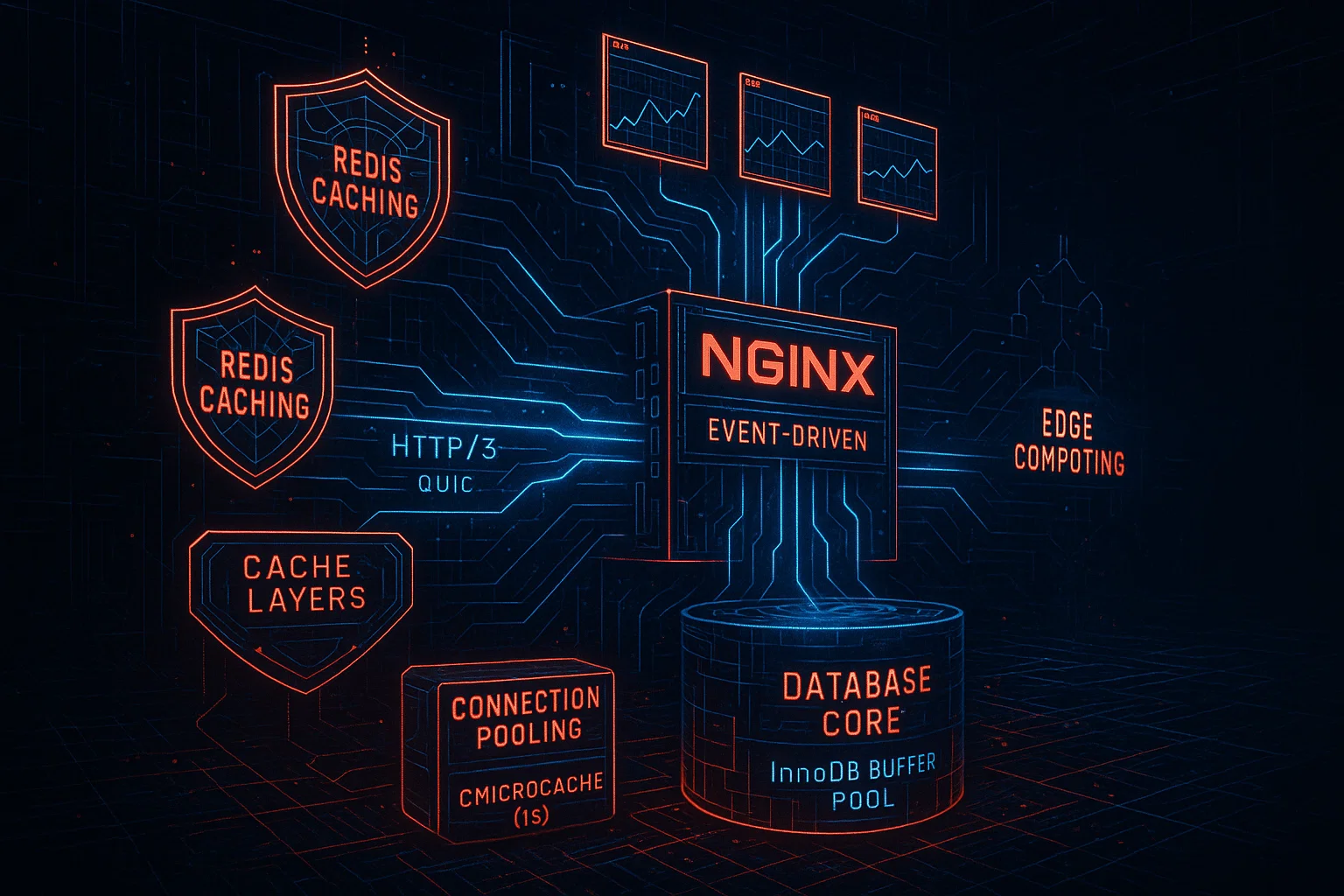

تحلیل عمیق معماری Nginx

انجیناکس (Nginx) با رویکردی متفاوت طراحی شده است: معماری رویداد-محور (Event-Driven) و ناهمگام (Asynchronous). برخلاف آپاچی که برای هر اتصال یک واحد پردازشی (Thread/Process) اختصاص میدهد، Nginx از تعداد کمی فرآیند کارگر (Worker Process) استفاده میکند که هر کدام میتوانند هزاران اتصال را در یک حلقه رویداد (Event Loop) مدیریت کنند.

این معماری باعث میشود مصرف حافظه در Nginx بسیار پایین و قابل پیشبینی باشد، حتی در زیر بار سنگین. Nginx درخواستها را به صورت غیرمسدودکننده (Non-blocking) پردازش میکند؛ یعنی اگر یک درخواست منتظر دیسک یا دیتابیس باشد، فرآیند کارگر متوقف نمیشود و به سراغ درخواست بعدی میرود. این ویژگی Nginx را برای سرویسدهی فایلهای استاتیک و عمل به عنوان Reverse Proxy بیرقیب میسازد.

جدول مقایسه فنی Apache MPM Event و Nginx

| پارامتر معماری | Apache (MPM Event) | Nginx (Event-Driven) |

| مدیریت همزمانی | Hybrid (Threads + Listener) | Asynchronous Event Loop |

| Context Switching | متوسط (به دلیل تعداد Threadها) | بسیار پایین (کمترین سربار CPU) |

| مصرف حافظه | متوسط (هر Thread پشته حافظه خود را دارد) | بسیار پایین (اشتراک منابع در Worker) |

| پیکربندی | غیرمتمرکز (.htaccess قابل استفاده است) |

متمرکز (فقط nginx.conf) |

| عملکرد فایل استاتیک | خوب (استفاده از sendfile) |

عالی (بهینهسازی شده برای I/O بالا) |

استراتژیهای پیشرفته تیونینگ Nginx

برای استخراج حداکثر توان از Nginx، تنظیمات پیشفرض کافی نیستند و باید پارامترها را بر اساس سختافزار و نوع ترافیک تنظیم کرد.

۱. بهینهسازی Worker Processes و اتصالات

دستور worker_processes باید معمولاً برابر با تعداد هستههای فیزیکی CPU تنظیم شود تا از Context Switching غیرضروری بین هستهها جلوگیری شود. همچنین، استفاده از worker_cpu_affinity برای متصل کردن هر کارگر به یک هسته خاص، میتواند عملکرد کش CPU (L1/L2 Cache) را بهبود بخشد.

پارامتر worker_connections تعیین میکند هر کارگر چند اتصال همزمان را میتواند باز نگه دارد. در سرورهایی که به عنوان Reverse Proxy عمل میکنند، باید توجه داشت که هر درخواست کاربر دو اتصال مصرف میکند (یکی به کاربر، یکی به Backend). بنابراین فرمول محاسبه ظرفیت واقعی به صورت زیر است:

Max_Concurrent_Users=2worker_processes×worker_connections

برای جلوگیری از خطای “Too many open files”، مقدار worker_rlimit_nofile در سطح پیکربندی Nginx و همچنین محدودیتهای سیستمعامل (ulimit) باید افزایش یابد.

۲. مدیریت بافرها و Timeouts

تنظیم دقیق بافرها برای مدیریت درخواستهای POST بزرگ و جلوگیری از نوشتنهای موقت روی دیسک حیاتی است:

client_body_buffer_size: باید به اندازهای باشد که اکثر درخواستهای POST (مانند فرمها) در حافظه جا شوند.client_max_body_size: برای امنیت و جلوگیری از حملات DoS باید محدود شود، مگر در مسیرهای آپلود فایل.

تایماوتها نیز نقش مهمی در آزادسازی منابع دارند. keepalive_timeout بالا اگرچه برای تجربه کاربری خوب است (جلوگیری از ایجاد اتصال مجدد)، اما در ترافیک بالا میتواند باعث اشغال تمام اسلاتهای اتصال شود. مقداری بین ۱۵ تا ۳۰ ثانیه معمولاً تعادل مناسبی است. همچنین فعالسازی reset_timedout_connection on باعث میشود Nginx اتصالاتی را که کلاینت پاسخ نمیدهد، سریعاً و با ارسال RST ببندد تا منابع آزاد شوند.

۳. بهینهسازی SSL/TLS برای کاهش TTFB

Handshake پروتکل SSL/TLS یکی از پرهزینهترین مراحل اتصال است. بهینهسازیهای زیر میتوانند تأخیر اولیه را به شدت کاهش دهند:

- OCSP Stapling: با فعالسازی

ssl_stapling، سرور وضعیت اعتبار گواهی را از طرف کلاینت بررسی کرده و ضمیمه میکند، که نیاز کلاینت به اتصال جداگانه به صادرکننده گواهی (CA) را حذف میکند. - SSL Session Cache: فعالسازی

ssl_session_cacheبه کلاینتهای بازگشتی اجازه میدهد تا پارامترهای رمزنگاری قبلی را استفاده کنند و Handshake کامل را دور بزنند. - تنظیم اندازه بافر SSL: کاهش

ssl_buffer_sizeمیتواند باعث شود اولین بایتهای داده سریعتر ارسال شوند (TTFB بهتر)، در حالی که مقدار بزرگتر برای پهنای باند کلی بهتر است. برای وبسایتهای تعاملی، مقادیر کوچکتر ترجیح داده میشوند.

فصل سوم: استراتژیهای پیشرفته کشینگ (Server-Side Caching)

کشینگ، موثرترین و مقرونبهصرفهترین روش برای بهبود مقیاسپذیری و سرعت است. یک استراتژی جامع کشینگ باید به صورت لایهای پیادهسازی شود تا درخواستها در نزدیکترین نقطه ممکن به کاربر پاسخ داده شوند.

۱. کشینگ دیتابیس و آبجکت: Redis در برابر Memcached

در لایه Backend، هدف کاهش بار روی دیتابیس با ذخیرهسازی نتایج کوئریها و آبجکتهای پردازششده است.

Redis (Remote Dictionary Server): ردیس فراتر از یک سیستم Key-Value ساده است و از ساختارهای داده پیچیده مانند هشها، لیستها و مجموعهها پشتیبانی میکند. این ویژگی آن را برای سناریوهای پیچیده مثل صفها (Queues)، شمارندههای بلادرنگ و کشینگ سشنها ایدهآل میسازد. ردیس قابلیت Persistence دارد، یعنی میتوان دادهها را روی دیسک ذخیره کرد تا در صورت ریستارت سرور از بین نروند.

سیاستهای تخلیه حافظه (Eviction Policies) در Redis: وقتی حافظه اختصاص یافته (maxmemory) پر میشود، انتخاب سیاست مناسب برای حذف دادههای قدیمی حیاتی است:

- allkeys-lru: این سیاست برای کشینگ وب عمومی بهترین گزینه است. ردیس کماستفادهترین کلیدها را از بین تمام کلیدها حذف میکند تا فضا برای دادههای جدید باز شود. این روش تضمین میکند که “دادههای داغ” (Hot Data) همیشه در دسترس هستند.

- volatile-lru: تنها کلیدهایی را حذف میکند که دارای زمان انقضا (TTL) هستند. اگر برنامهای دارید که برخی دادهها باید دائمی بمانند، این گزینه مناسبتر است.

Memcached: یک سیستم سادهتر و چندنخی (Multi-threaded) است که برای مقیاسدهی افقی و پردازشهای ساده Key-Value طراحی شده است. در معماریهای بسیار بزرگ که سادگی و استفاده حداکثری از هستههای CPU اولویت دارد، Memcached ممکن است برتریهای جزئی داشته باشد، اما ردیس به دلیل غنای ویژگیها، انتخاب غالب در سال ۲۰۲۴ است.

۲. کشینگ تمام صفحه (Full Page Cache): Varnish و Nginx FastCGI

کشینگ صفحه، پاسخ HTML کامل را ذخیره میکند و نیاز به اجرای کدهای سمت سرور (مانند PHP) و کوئریهای دیتابیس را به طور کامل حذف میکند. این لایه بیشترین تأثیر را بر کاهش TTFB دارد.

Varnish Cache: وارنیش یک شتابدهنده HTTP تخصصی است که جلوی وبسرور قرار میگیرد. قدرت اصلی وارنیش در زبان پیکربندی آن (VCL) نهفته است که انعطافپذیری بینظیری در مدیریت درخواستها میدهد.

- مدیریت هوشمند: وارنیش میتواند بر اساس کوکیها، نوع دستگاه کاربر یا هدرهای خاص، نسخههای مختلفی از کش را سرو کند.

- Grace Mode: این قابلیت به وارنیش اجازه میدهد در صورتی که Backend کند است یا خطا میدهد، نسخه قدیمی (Stale) محتوا را به کاربر نمایش دهد، که پایداری سایت را به شدت افزایش میدهد.

Nginx FastCGI Cache & Microcaching: اگر امکان استفاده از وارنیش وجود ندارد، ماژول fastcgi_cache در Nginx جایگزین قدرتمندی است. تکنیک Microcaching در اینجا بسیار کارآمد است. در این روش، محتوای داینامیک برای مدت بسیار کوتاهی (مثلاً ۱ ثانیه) کش میشود. در سایتی با ترافیک بالا (مثلاً ۱۰۰۰ درخواست در ثانیه)، کش کردن حتی برای ۱ ثانیه باعث میشود که سرور به جای ۱۰۰۰ بار پردازش، تنها ۱ بار پردازش انجام دهد و ۹۹۹ درخواست دیگر را از حافظه پاسخ دهد. این تکنیک میتواند بار CPU را تا ۹۰٪ کاهش دهد.

Nginx

# نمونه کانفیگ Microcaching

fastcgi_cache_path /tmp/nginx_cache levels=1:2 keys_zone=microcache:10m max_size=1g inactive=60m;

fastcgi_cache_key "$scheme$request_method$host$request_uri";

fastcgi_cache_valid 200 1s; # کش برای تنها ۱ ثانیه

fastcgi_cache_use_stale updating error timeout; # استفاده از محتوای قدیمی در حین آپدیت

fastcgi_cache_lock on; # جلوگیری از هجوم درخواستها به Backend (Dog-pile effect)

استفاده از fastcgi_cache_lock تضمین میکند که وقتی کش منقضی میشود، تنها یک درخواست به Backend ارسال میشود تا کش را تازه کند و سایر درخواستها منتظر میمانند یا نسخه قدیمی را دریافت میکنند، که از سربار ناگهانی سرور جلوگیری میکند.

۳. استراتژی Stale-While-Revalidate

این الگوی مدرن کشینگ که هم در مرورگرها و هم در CDNها و Nginx قابل پیادهسازی است، پارادایم “سرعت در برابر تازگی” را حل میکند. این استراتژی به سیستم اجازه میدهد تا یک نسخه قدیمی (Stale) از محتوا را فوراً به کاربر تحویل دهد، و همزمان در پسزمینه یک درخواست ناهمگام برای دریافت نسخه تازه به سرور ارسال کند. نتیجه: کاربر تأخیر صفر را تجربه میکند (چون از کش میخواند) و کش نیز به طور مداوم بهروز میشود. در Nginx، ترکیب proxy_cache_background_update on و proxy_cache_use_stale updating این رفتار را شبیهسازی میکند.

فصل چهارم: بهینهسازی عمیق پایگاه داده (MySQL و PostgreSQL)

اغلب اوقات، کندی سرور و TTFB بالا ریشه در لایه پایگاه داده دارد. بهینهسازی کوئریها و تنظیمات حافظه دیتابیس تأثیر مستقیمی بر عملکرد کلی سیستم دارد.

بهینهسازی پیشرفته MySQL 8

در MySQL، موتور ذخیرهسازی InnoDB استاندارد است و عملکرد آن به شدت به مدیریت حافظه وابسته است.

۱. تیونینگ InnoDB Buffer Pool

پارامتر innodb_buffer_pool_size حیاتیترین تنظیم MySQL است. این بافر نه تنها دادهها، بلکه ایندکسها را نیز در حافظه نگه میدارد. هدف نهایی این است که تمام “مجموعه دادههای فعال” (Working Set) در این بافر جای گیرند تا نیاز به خواندن از دیسک (Disk I/O) به صفر برسد.

- قانون سرانگشتی: در یک سرور اختصاصی دیتابیس، توصیه میشود ۵۰٪ تا ۷۵٪ از کل RAM به این بافر اختصاص یابد. اختصاص بیش از حد میتواند باعث شود سیستمعامل برای فرآیندهای خود دچار کمبود حافظه شده و وارد Swap شود.

- مدیریت قطعات (Chunks) و نمونهها (Instances): برای بافرهای بزرگ (بیش از ۱ گیگابایت)، تنظیم

innodb_buffer_pool_instancesبه عددی بزرگتر از ۱ (معمولاً برابر تعداد هستههای CPU) باعث میشود که رقابت رشتهها (Thread Contention) برای دسترسی به حافظه کاهش یابد و همزمانی بهبود یابد.

۲. تحلیل و رفع گلوگاههای کوئری (Query Optimization)

فعالسازی slow_query_log با آستانه زمانی پایین (مثلاً ۰.۵ یا ۱ ثانیه) اولین گام است. اما خواندن فایلهای لاگ خام دشوار است. استفاده از ابزارهایی مانند pt-query-digest (از مجموعه Percona Toolkit) برای تجمیع و تحلیل لاگها ضروری است. این ابزار نشان میدهد کدام کوئریها بیشترین زمان تجمعی را مصرف کردهاند. اغلب اوقات، افزودن یک ایندکس ترکیبی (Composite Index) یا بازنویسی یک کوئری JOIN ناکارآمد میتواند بار سرور را دهها برابر کاهش دهد.

معماری و بهینهسازی PostgreSQL

پستگرس معماری متفاوتی در مدیریت حافظه دارد و بیشتر به کش سیستمعامل (OS Page Cache) متکی است.

۱. Shared Buffers و Work Mem

- shared_buffers: بر خلاف MySQL، در پستگرس توصیه نمیشود که بخش اعظم RAM به

shared_buffersاختصاص یابد. مقداری حدود ۲۵٪ تا ۴۰٪ از RAM معمولاً ایدهآل است. پستگرس از “بافرینگ دوگانه” استفاده میکند؛ یعنی دادهها هم در بافر خود پستگرس و هم در کش سیستمعامل وجود دارند. - work_mem: این پارامتر تعیین میکند که هر عملیات مرتبسازی (Sort) یا هش (Hash) چقدر حافظه میتواند مصرف کند قبل از اینکه دادهها را روی دیسک (Temp files) بنویسد. تنظیم دقیق این پارامتر حیاتی و خطرناک است؛ زیرا این محدودیت به ازای هر عملیات است، نه هر اتصال. یک کوئری پیچیده با چندین Sort ممکن است چندین برابر

work_memحافظه مصرف کند. تنظیم مقدار بالا در ترافیک سنگین میتواند سریعاً منجر به خطای Out of Memory (OOM) شود.

۲. مدیریت استخر اتصالات: PgBouncer

پستگرس برای هر اتصال کلاینت، یک فرآیند سنگین (OS Process) ایجاد میکند. هزینه ایجاد و مدیریت این فرآیندها بالاست. در وبسایتهای پرترافیک، اتصال مستقیم اپلیکیشن به پستگرس مقیاسپذیر نیست. PgBouncer یک ابزار استاندارد برای حل این مشکل است.

مقایسه حالتهای Pooling در PgBouncer:

- Session Pooling: اتصال سرور تا زمانی که سشن کلاینت باز است، اشغال میماند. این روش سربار ایجاد اتصال (Connection Overhead) را حذف میکند اما تعداد اتصالات همزمان به دیتابیس را کاهش نمیدهد.

- Transaction Pooling: این حالت کارآمدترین روش برای وب است. اتصال سرور تنها در طول اجرای یک تراکنش (Transaction) به کلاینت اختصاص مییابد و بلافاصله پس از پایان تراکنش (Commit/Rollback) به استخر برمیگردد.

- تأثیر بر عملکرد: بنچمارکها نشان میدهند که استفاده از Transaction Pooling میتواند توان عملیاتی (Throughput) را تا ۶۰٪ نسبت به حالت عادی افزایش دهد و امکان مدیریت هزاران کلاینت همزمان را با تعداد اندکی اتصال واقعی به دیتابیس (مثلاً ۵۰ اتصال) فراهم کند. محدودیت این روش عدم پشتیبانی از ویژگیهای وابسته به سشن مانند جداول موقت (Temp Tables) یا Prepared Statements در سطح سشن است (هرچند نسخههای جدیدتر PgBouncer پشتیبانی محدودی از Prepared Statements اضافه کردهاند).

استفاده از ProxySQL برای MySQL

مشابه PgBouncer، برای MySQL نیز ابزار ProxySQL وجود دارد که قابلیتهای پیشرفتهای مانند Multiplexing (استفاده اشتراکی از اتصالات Backend) و Query Routing (جداسازی ترافیک خواندن و نوشتن) را ارائه میدهد. Multiplexing در ProxySQL به طور چشمگیری تعداد اتصالات باز روی دیتابیس را کاهش میدهد و میتواند ترافیکهای ناگهانی را بدون درگیر کردن مستقیم دیتابیس مدیریت کند.

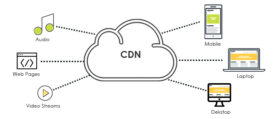

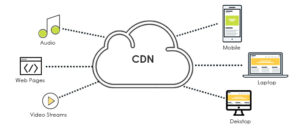

فصل پنجم: شبکه توزیع محتوا (CDN) و محاسبات لبه (Edge Computing)

در معماریهای نوین سال ۲۰۲۵، مرز بین سرور و CDN محو شده است. CDNها دیگر فقط کشکننده فایلهای استاتیک نیستند، بلکه پلتفرمهای محاسباتی قابل برنامهریزی هستند که میتوانند منطق برنامه را در نزدیکترین نقطه به کاربر اجرا کنند.

نبرد غولهای لبه: Cloudflare در برابر Fastly

انتخاب بین این دو ارائهدهنده بستگی به نیازهای معماری دارد:

Cloudflare (Workers & KV): کلودفلر با معرفی Workers، امکان اجرای کدهای JavaScript (و WebAssembly) را روی شبکه جهانی خود فراهم کرده است. این قابلیت برای سناریوهایی مانند A/B Testing بسیار قدرتمند است. به جای اینکه سرور اصلی تصمیم بگیرد کدام نسخه صفحه را به کاربر نشان دهد (که باعث تأخیر و عدم استفاده از کش میشود)، Worker در لبه میتواند بر اساس کوکی یا منطقه جغرافیایی تصمیمگیری کند و نسخه مناسب را سرو نماید. این کار تأخیر سمت سرور را برای تستهای A/B حذف میکند.

Fastly (VCL & Surrogate Keys): Fastly بر پایه Varnish بنا شده و دسترسی مستقیم به VCL را فراهم میکند. ویژگی متمایز Fastly، سیستم Instant Purge و Surrogate Keys است. در این سیستم، میتوان به هر پاسخ HTTP چندین “برچسب” (Tag) یا کلید Surrogate اختصاص داد (مثلاً product_123، category_shoes). وقتی قیمت یک محصول تغییر میکند، سرور میتواند با ارسال یک درخواست API، تمام صفحات دارای برچسب product_123 را در کسری از ثانیه (کمتر از ۱۵۰ میلیثانیه) از تمام نقاط جهان پاک کند. این قابلیت برای فروشگاههای اینترنتی بزرگ و سایتهای خبری که محتوای نیمهپویا دارند، حیاتی است و به آنها اجازه میدهد حتی محتوای HTML داینامیک را برای مدت طولانی کش کنند.

بهینهسازی تصاویر در لبه (Edge Image Optimization)

تصاویر معمولاً سنگینترین بخش LCP هستند. استفاده از سرویسهای تغییر اندازه و تبدیل فرمت در لبه (مانند Cloudflare Images یا Fastly Image Optimizer) ضروری است. با استفاده از یک Cloudflare Worker ساده، میتوان هدر Accept مرورگر را بررسی کرد و تشخیص داد آیا مرورگر از فرمتهای مدرن مانند AVIF پشتیبانی میکند یا خیر. سپس Worker میتواند درخواست را به سرویس تغییر اندازه ارسال کرده و تصویر بهینه شده (مثلاً WebP یا AVIF با ابعاد دقیق مورد نیاز) را تحویل دهد.

JavaScript

// شبهکد منطق Worker برای انتخاب فرمت تصویر

const accept = request.headers.get("accept");

let format = "jpeg"; // پیشفرض

if (accept.includes("image/avif")) format = "avif";

else if (accept.includes("image/webp")) format = "webp";

// درخواست به سرویس تغییر اندازه با فرمت انتخاب شده

return fetch(imageResizingUrl, { cf: { image: { format } } });

این روش بار پردازشی سنگین تبدیل تصویر را از سرور اصلی حذف میکند و حجم دانلود کاربر را به شدت کاهش میدهد که مستقیماً LCP را بهبود میبخشد.

فصل ششم: تأثیر تجاری، مانیتورینگ و مطالعات موردی

تمام تلاشهای فنی فصلهای قبل باید در نهایت منجر به بهبود شاخصهای تجاری و رتبهبندی شود.

همبستگی سرعت و درآمد: شواهد آماری

دادههای جمعآوری شده از شرکتهای پیشرو نشاندهنده رابطه مستقیم و غیرخطی بین Core Web Vitals و درآمد است:

- راکوتن (Rakuten 24): این غول تجارت الکترونیک ژاپنی، با اجرای پروژهای متمرکز بر بهبود Core Web Vitals، نتایج خیرهکنندهای گرفت. آنها با بهبود LCP و کاهش CLS، توانستند ۵۳.۳۷٪ افزایش در درآمد به ازای هر بازدیدکننده (Revenue Per Visitor) و ۳۳.۱۳٪ افزایش در نرخ تبدیل را ثبت کنند. همچنین نرخ خروج (Exit Rate) تا ۳۵٪ کاهش یافت.

- وودافون (Vodafone): در یک مطالعه A/B تست دقیق، وودافون نسخه بهینهسازی شده صفحه فرود خود را (که ۳۱٪ بهبود در LCP داشت) با نسخه قبلی مقایسه کرد. نتیجه، ۸٪ افزایش در فروش کل، ۱۵٪ افزایش در نرخ تبدیل بازدیدکننده به لید (Lead) و ۱۱٪ افزایش در نرخ افزودن به سبد خرید بود.

این دادهها ثابت میکنند که هزینه برای بهینهسازی زیرساخت، یک سرمایهگذاری با بازگشت سرمایه (ROI) بسیار بالا است.

ابزارهای دقیق مانیتورینگ و تشخیص

برای حفظ این عملکرد، نیاز به دید دقیق به داخل سرور است. ابزارهای خط فرمان لینوکس اطلاعات حیاتی ارائه میدهند:

- iostat -x 1: برای بررسی گلوگاههای دیسک. ستون

%utilنشان میدهد دیسک چقدر مشغول است. اگر این عدد مدام نزدیک ۱۰۰٪ باشد، دیسک گلوگاه است و باید به NVMe ارتقا یابد یا کشینگ تهاجمیتر شود. - vmstat 1: ستونهای

siوso(Swap In/Out) باید همیشه صفر باشند. هر مقداری غیر از صفر نشاندهنده کمبود RAM و افت شدید عملکرد است. - htop: برای مشاهده توزیع بار روی هستههای CPU.

شفافیت با هدر Server-Timing

یک تکنیک پیشرفته برای ارتباط بین تیمهای Backend و Frontend، استفاده از هدر Server-Timing است. سرور میتواند زمان دقیق صرف شده در دیتابیس، کش، و پردازش کد را در پاسخ HTTP ارسال کند.

HTTP

Server-Timing: db;dur=53, cache;desc="miss", app;dur=120

این اطلاعات در تب Network در Chrome DevTools نمایش داده میشود و به توسعهدهندگان اجازه میدهد دقیقاً بفهمند که آیا کندی LCP ناشی از شبکه است یا پردازش کند دیتابیس.

نتیجهگیری

بهینهسازی عملکرد سرور در سال ۲۰۲۵، فراتر از نصب یک افزونه کش ساده است. این فرآیند نیازمند بازمهندسی معماری وبسرور (مهاجرت به رویکردهای Event-Driven در Nginx یا Apache)، پیادهسازی استراتژیهای کشینگ چندلایه (از Redis و Varnish تا Microcaching)، بهینهسازی عمیق دیتابیس (مدیریت بافرها و Connection Pooling) و بهرهگیری هوشمندانه از لبه شبکه (Edge Computing) است. شواهد غیرقابلانکار از شرکتهایی نظیر راکوتن و وودافون نشان میدهد که این بهینهسازیها تأثیری مستقیم و قدرتمند بر خط آخر سودآوری شرکت و جایگاه آن در نتایج جستجوی گوگل دارند. در بازاری که رقابت بر سر میلیثانیههاست، سرعت دیگر یک ویژگی نیست؛ بلکه بقاست.