فهرست مطالب

پادکست آینده رایانش ابری در سال ۲۰۲۶ و بعدتر

چکیده اجرایی: نقطه عطف همگرایی دیجیتال

سال ۲۰۲۵ در تاریخ فناوری اطلاعات به عنوان سالی ثبت خواهد شد که در آن رایانش ابری از یک «مکان» برای ذخیرهسازی و پردازش، به یک «بافت» محاسباتی فراگیر و هوشمند تبدیل شد. ما دیگر صرفاً با پذیرش ابری (Cloud Adoption) مواجه نیستیم، بلکه شاهد تبلور مفهوم «ابر بومی هوشمند» (Intelligent Cloud-Native) هستیم که در آن مرزهای فیزیکی و منطقی میان دیتاسنترهای متمرکز، لبه شبکه و دستگاههای انتهایی محو شده است. این گزارش جامع تحلیلی، با بررسی دقیق دادههای بازار، تحولات تکنولوژیک و تغییرات ژئوپلیتیک، نشان میدهد که چگونه همگرایی هوش مصنوعی مولد (Generative AI)، محاسبات لبهای (Edge Computing) و تهدید/فرصت محاسبات کوانتومی (Quantum Computing)، معماری کسبوکارهای جهانی را بازتعریف کرده است.

بر اساس تحلیلهای کلان، هزینههای زیرساخت ابری در سال ۲۰۲۵ با رشدی خیرهکننده و بیسابقه مواجه شده است. دادههای بازار حاکی از آن است که ۵۱ درصد از کل هزینههای فناوری اطلاعات سازمانها اکنون از ابزارهای سنتی به راهحلهای ابری منتقل شده است که نشاندهنده عبور از یک نقطه عطف حیاتی (Tipping Point) در اقتصاد دیجیتال است.1 این تغییر جهت سرمایه، تنها یک جابجایی بودجه نیست؛ بلکه بازتابی از یک تغییر استراتژیک بنیادین است که در آن سازمانها برای بقا در عصر هوش مصنوعی، مجبور به نوسازی کامل زیرساختهای خود شدهاند. این گزارش با عمقی ژورنالیستی و دقت علمی، لایههای پنهان این تحولات را شکافته و چشماندازی دقیق از دهه پیش رو ارائه میدهد.

فصل اول: اقتصاد کلان ابر و تغییرات ساختاری بازار جهانی

۱.۱ تحلیل دینامیک بازار و جریان سرمایه

اقتصاد رایانش ابری در سال ۲۰۲۵ وارد فاز جدیدی از بلوغ و همزمان رشد شتابان شده است. برخلاف پیشبینیهای محافظهکارانه اوایل دهه ۲۰۲۰، بازار نه تنها اشباع نشده، بلکه به لطف محرکهای قدرتمندی همچون هوش مصنوعی مولد، وارد یک «ابرچخه» (Supercycle) سرمایهگذاری شده است. تحلیلگران بازار پیشبینی میکنند که ارزش بازار جهانی رایانش ابری در سال ۲۰۲۵ به رقم خیرهکننده ۹۱۲.۷۷ میلیارد دلار رسیده است. این رقم تنها یک ایستگاه در مسیر صعودی است؛ چرا که برآوردها نشان میدهد این بازار تا سال ۲۰۳۴ با نرخ رشد مرکب سالانه (CAGR) ۲۱.۲ درصد به ۵.۱۵ تریلیون دلار خواهد رسید.2 این حجم از خلق ارزش، رایانش ابری را از یک صنعت جانبی به ستون فقرات اقتصاد جهانی تبدیل کرده است.

نکته قابل تامل در این آمارها، تغییر ماهیت هزینهکردهاست. در حالی که در دهه گذشته تمرکز بر انتقال برنامههای موجود به ابر (Lift and Shift) بود، در سال ۲۰۲۵ سرمایهگذاریها بر ایجاد قابلیتهای جدید متمرکز شده است. بر اساس گزارشهای Gartner، هزینههای نهایی کاربران برای خدمات ابری عمومی در سال ۲۰۲۵ به ۷۲۳ میلیارد دلار رسیده که رشدی ۲۱.۵ درصدی را نسبت به سال قبل نشان میدهد.2 این جهش در هزینهها مستقیماً با نیاز سیریناپذیر کسبوکارها به زیرساختهای مقیاسپذیر برای اجرای مدلهای هوش مصنوعی مرتبط است.

تحلیل مککینزی نشان میدهد که پذیرش ابری در میان شرکتهای لیست Forbes Global 2000، در حال حاضر ارزشی فراتر از ۱ تریلیون دلار در سود قبل از بهره، مالیات و استهلاک (EBITDA) ایجاد کرده است و پیشبینی میشود این رقم تا سال ۲۰۳۰ به ۳ تریلیون دلار برسد.1 این دادهها بیانگر این حقیقت است که ابر دیگر یک مرکز هزینه نیست، بلکه موتور اصلی خلق حاشیه سود و ارزش افزوده برای بزرگترین بنگاههای اقتصادی جهان محسوب میشود.

| بخش بازار | هزینه سال ۲۰۲۴ (میلیون دلار) | رشد سال ۲۰۲۴ (درصد) | هزینه پیشبینی ۲۰۲۵ (میلیون دلار) | رشد پیشبینی ۲۰۲۵ (درصد) | تحلیل روند |

| زیرساخت به عنوان سرویس (IaaS) | ۱۶۹,۸۱۸ | ۲۱.۳٪ | ۲۱۱,۹۰۰ (تخمینی) | ۲۴.۸٪ | رشد شتابان به دلیل تقاضای زیرساخت AI و GPU |

| پلتفرم به عنوان سرویس (PaaS) | ۱۷۲,۴۰۰ | — | — | ۲۵.۵٪ (تخمینی) | افزایش استفاده از پلتفرمهای توسعه مدرن و Data Ops |

| نرمافزار به عنوان سرویس (SaaS) | ۲۵۰,۸۰۴ | ۱۸.۱٪ | ۲۹۹,۱۰۰ (تخمینی) | ۱۹.۲٪ | جایگزینی کامل نرمافزارهای Legacy با راهکارهای ابری |

| مجموع بازار ابری عمومی | ۵۹۵,۶۵۲ | ۱۹.۲٪ | ۷۲۳,۰۰۰ | ۲۱.۵٪ | ورود به فاز رشد نمایی ناشی از همگرایی تکنولوژیها |

جدول ۱: تحلیل تطبیقی رشد بخشهای مختلف بازار ابری بر اساس دادههای Gartner و IDC 1

۱.۲ جغرافیای سیاسی ابر: تمرکز و رقابت

در سال ۲۰۲۵، بازار ابری همچنان شاهد تمرکز بالایی است، اما بازیگران جدیدی در حال تغییر توازن قدرت هستند. پنج ارائهدهنده برتر IaaS (شامل AWS، Azure، Google Cloud، Alibaba و Huawei) مجموعاً ۸۲.۱ درصد از بازار را در اختیار دارند.1 این تمرکز بالا، نگرانیهایی را در خصوص ریسک تمرکز (Concentration Risk) برای نهادهای نظارتی و مدیران ارشد فناوری (CIOs) ایجاد کرده است.4 با این حال، نبردی سهمگین برای کسب رتبه سوم و چهارم در جریان است. گوگل با تثبیت سهم ۹ درصدی خود جایگاه سوم را مستحکم کرده، در حالی که علیبابا با ۷.۲ درصد و هواوی با ۴.۳ درصد در تعقیب آن هستند.1

این دادهها نشاندهنده یک شکاف ژئوپلیتیک در زیرساخت ابری است؛ جایی که اکوسیستم غربی تحت سلطه سه غول آمریکایی است و اکوسیستم شرقی توسط بازیگران چینی رهبری میشود. اما پدیده مهمتر سال ۲۰۲۵، فرسایش قدرت مطلق «هایپراسکیلرها» در لایههای تخصصی توسط بازیگران چابک و جدید است که در فصلهای بعدی به تفصیل به آنها خواهیم پرداخت.

فصل دوم: ظهور نئوکلادها (Neoclouds) و انقلاب سختافزاری

۲.۱ نئوکلادها: شورش علیه مجازیسازی سنتی

یکی از جذابترین و مخربترین روندهای سال ۲۰۲۵، ظهور «نئوکلادها» (Neoclouds) است. در حالی که هایپراسکیلرهای سنتی (AWS، Azure، GCP) امپراتوری خود را بر پایه مجازیسازی عمومی و سرویسهای همگانی بنا کردند، نئوکلادهایی مانند CoreWeave، Lambda، Nebius و Vultr با یک استراتژی کاملاً متفاوت وارد میدان شدهاند: تمرکز لیزری بر زیرساختهای هوش مصنوعی و حذف لایههای اضافی نرمافزاری.5

مشکل بنیادین هایپراسکیلرهای سنتی در مواجهه با بارهای کاری هوش مصنوعی مدرن، پدیدهای به نام «مالیات مجازیسازی» (Virtualization Tax) است. در معماریهای سنتی ابری، لایه Hypervisor که مسئول مدیریت ماشینهای مجازی است، سربار قابل توجهی بر ارتباطات شبکه و دسترسی به سختافزار ایجاد میکند. برای مدلهای زبانی بزرگ (LLM) که نیازمند ارتباط بلادرنگ و با تأخیر میکروثانیهای بین هزاران پردازنده گرافیکی (GPU) هستند، این سربار غیرقابل قبول است.

نئوکلادها با ارائه دسترسی “Bare Metal” (فلز عریان) و استفاده از معماریهای شبکه تخصصی، این گلوگاه را حذف کردهاند. به عنوان مثال، شرکت CoreWeave با بهرهگیری از واحدهای پردازش داده (DPU) شرکت NVIDIA (مانند BlueField)، کل سیستمعامل ابری، مدیریت شبکه و امنیت را از پردازنده اصلی جدا کرده و بر روی DPU اجرا میکند. این معماری نوین به مشتریان اجازه میدهد تا از ۱۰۰ درصد توان محاسباتی GPUها استفاده کنند، در حالی که همچنان از ایزولاسیون امنیتی ابری (VPC) بهرهمند هستند.7

این مزیت فنی باعث شده است که نئوکلادها نه تنها مشتریان استارتاپی، بلکه غولهای تکنولوژی را نیز جذب کنند. گزارشها حاکی از آن است که مایکروسافت برای تأمین نیازهای پردازشی عظیم OpenAI، قراردادهای چند میلیارد دلاری با CoreWeave امضا کرده است، که نشاندهنده ناتوانی زیرساختهای سنتی حتی در بزرگترین شرکتهای ابری جهان برای پاسخگویی به تقاضای انفجاری هوش مصنوعی است.7

۲.۲ جنگ استانداردها: InfiniBand در برابر Ultra Ethernet

در سال ۲۰۲۵، گلوگاه اصلی در آموزش مدلهای هوش مصنوعی دیگر قدرت پردازش GPU نیست، بلکه سرعت انتقال داده بین آنهاست. ترافیک دیتاسنترها که قبلاً عمدتاً «شمال-جنوب» (کاربر به سرور) بود، اکنون به ترافیک عظیم «شرق-غرب» (سرور به سرور) برای همگامسازی گرادیانها در طول آموزش مدل تغییر یافته است. این تغییر پارادایم، آتش جنگ استانداردهای شبکه را شعلهور کرده است.

تکنولوژی InfiniBand، با قابلیتهای ذاتی خود مانند تأخیر بسیار پایین و دسترسی مستقیم به حافظه از راه دور (RDMA)، سالها استاندارد طلایی برای خوشههای محاسباتی (HPC) بود. اما انحصار این تکنولوژی در دست شرکت NVIDIA (پس از خرید Mellanox) و هزینههای بالای آن، صنعت را به سمت توسعه جایگزین سوق داد. در پاسخ، کنسرسیوم اولترا اترنت (Ultra Ethernet Consortium – UEC) در سال ۲۰۲۵ مشخصات جدیدی را منتشر کرد که هدف آن آوردن قابلیتهای کلاس InfiniBand به بستر استاندارد و ارزانتر اترنت است.9

معماریهای جدید مبتنی بر UEC با بازسازی پشته شبکه (Network Stack) و بهینهسازی پروتکلهای انتقال برای جلوگیری از ازدحام (Congestion Control)، وعده میدهند که عملکردی مشابه InfiniBand را با هزینهای کمتر و قابلیت همکاری بیشتر ارائه دهند. تحلیلهای فنی نشان میدهد که اگرچه InfiniBand هنوز در خوشههای بسیار عظیم (Super-clusters) برتری اندکی دارد، اما شکاف عملکردی به سرعت در حال بسته شدن است و اترنت به دلیل اکوسیستم باز و گستردهاش، شانس بالایی برای تسلط بر دیتاسنترهای AI در نیمه دوم دهه ۲۰۲۰ دارد.11

۲.۳ دیتاسنترهای مایع: پایان عصر هوا

افزایش تراکم ترانزیستورها و توان مصرفی چیپهای هوش مصنوعی، دیتاسنترها را به مرزهای فیزیکی خنککنندگی با هوا رسانده است. در سال ۲۰۲۳، میانگین توان مصرفی هر رک سرور حدود ۳۶ کیلووات بود، اما با ورود نسلهای جدید پردازندهها مانند NVIDIA Blackwell در سال ۲۰۲۵، این رقم در بسیاری از پروژهها از ۱۰۰ کیلووات فراتر رفته است. در چنین تراکمی، هوا دیگر توانایی انتقال حرارت کافی را ندارد.13

سال ۲۰۲۵ سال پذیرش عمومی خنککنندگی مایع (Liquid Cooling) است. فناوریهایی مانند “Direct-to-Chip” (که در آن مایع خنککننده مستقیماً از روی پردازنده عبور میکند) و “Immersion Cooling” (غوطهوری کامل سرور در مایع دیالکتریک) از حالت آزمایشگاهی خارج شده و به استاندارد طراحی دیتاسنترهای جدید تبدیل شدهاند. مایکروسافت در طراحی دیتاسنترهای جدید خود برای پروژههای هوش مصنوعی، سیستمهای خنککننده مداربسته مایع را پیادهسازی کرده است. این سیستمها نه تنها دمای عملیاتی را کاهش میدهند، بلکه با حذف فنهای پرمصرف سرورها، مصرف انرژی کلی دیتاسنتر را به شدت کاهش داده و شاخص بهرهوری مصرف انرژی (PUE) را بهبود میبخشند.15

فصل سوم: هوش مصنوعی مولد و بازتعریف معماری نرمافزار

۳.۱ از “Cloud-First” به “AI-Native”

تاثیر هوش مصنوعی بر رایانش ابری در سال ۲۰۲۵ فراتر از زیرساخت فیزیکی است و به لایههای معماری نرمافزار نفوذ کرده است. مفهوم “Cloud-First” که شعار دهه گذشته بود، جای خود را به “AI-Native” داده است. در این پارادایم جدید، برنامههای کاربردی از ابتدا با فرض وجود هوش مصنوعی در هسته خود طراحی میشوند، نه به عنوان یک افزونه جانبی.17

سازمانها در حال بازنویسی برنامههای خود برای ادغام عمیق با مدلهای زبانی بزرگ (LLM) و سیستمهای تولید محتوا هستند. این ادغام نیازمند معماریهای جدیدی برای مدیریت دادههای برداری (Vector Databases)، سیستمهای RAG (Retrieval-Augmented Generation) و خطوط لوله داده (Data Pipelines) پیچیده است. تحلیلگران پیشبینی میکنند که ۷۵ درصد از سازمانها تا سال ۲۰۲۷ فرآیندهای FinOps و DevOps خود را با هوش مصنوعی مولد ترکیب خواهند کرد.18

۳.۲ چالش هزینههای پنهان و اقتصاد توکنها

با حرکت به سوی مدلهای هوش مصنوعی، واحد اقتصادی رایانش ابری تغییر کرده است. در مدلهای سنتی IaaS، هزینه بر اساس زمان استفاده از ماشین مجازی (ساعت/پردازنده) محاسبه میشد. اما در عصر هوش مصنوعی، واحد سنجش به “Token” (برای مدلهای زبانی) و پیچیدگی استنتاج تبدیل شده است. این تغییر، چالشهای جدیدی را در پیشبینی و مدیریت هزینهها ایجاد کرده است.

بسیاری از سازمانها در سال ۲۰۲۵ با شوک هزینههای استنتاج (Inference Costs) مواجه شدهاند. برخلاف فاز آموزش مدل که هزینهای سنگین اما مقطعی است، هزینه استنتاج با افزایش تعداد کاربران و پیچیدگی درخواستها به صورت خطی یا حتی نمایی رشد میکند. این امر منجر به ظهور استراتژیهای جدیدی در مدیریت هزینه شده است، مانند استفاده از مدلهای کوچکتر و تخصصی (Small Language Models – SLMs) برای وظایف روتین و ذخیره مدلهای بزرگ و گرانقیمت برای استدلالهای پیچیده.19

فصل چهارم: رنسانس محاسبات لبهای و اینترنت اشیاء صنعتی

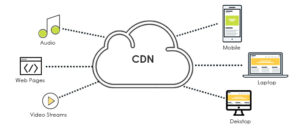

۴.۱ همگرایی Edge و Serverless: مدل Serverless Edge

سال ۲۰۲۵ شاهد بلوغ کامل محاسبات لبهای (Edge Computing) و ادغام آن با معماری بدون سرور (Serverless) است. این ترکیب که به “Serverless Edge” معروف شده، پاسخی به نیاز روزافزون برای پردازش داده در نزدیکترین نقطه به منبع تولید آن است. در این مدل، توسعهدهندگان میتوانند توابع (Functions) خود را بدون نگرانی از مدیریت سرورها یا زیرساخت، در نودهای لبهای شبکه توزیع کنند.21

فناوری کلیدی که این انقلاب را ممکن ساخته، WebAssembly (Wasm) است. کانتینرهای سنتی (مانند Docker) برای محیطهای لبهای با منابع محدود، سنگین و کند بودند. Wasm با ارائه یک محیط اجرایی بسیار سبک، ایمن (Sandboxed) و با زمان راهاندازی (Cold Start) در حد میلیثانیه، این مشکل را حل کرده است. تحقیقات نشان میدهد که استفاده از فریمورکهای مبتنی بر Wasm مانند WasmFlow میتواند تأخیر پردازش را تا ۷۴ برابر کاهش داده و تراکم اجرای توابع را نسبت به کانتینرهای سنتی به شدت افزایش دهد.22

۴.۲ مطالعه موردی: انقلاب بهرهوری انرژی در والمارت

یکی از برجستهترین نمونههای عملیاتی شدن محاسبات لبهای در مقیاس صنعتی، پروژه عظیم والمارت (Walmart) است. این غول خردهفروشی با پیادهسازی یک شبکه گسترده از دستگاههای لبهای در هزاران فروشگاه خود، مدیریت سیستمهای تهویه مطبوع (HVAC) و تبرید را متحول کرده است.

چالش اصلی والمارت این بود که ارسال دادههای هزاران حسگر دما و رطوبت به ابر مرکزی برای تحلیل و ارسال فرمان بازگشتی، هم با تأخیر همراه بود و هم پهنای باند زیادی مصرف میکرد. با استقرار پلتفرمهای لبهای، والمارت توانست پردازش دادهها را در محل فروشگاه انجام دهد. الگوریتمهای هوش مصنوعی مستقر در لبه، به صورت بلادرنگ و با توجه به شرایط محیطی، عملکرد کمپرسورها و فنها را تنظیم میکنند. نتیجه این پروژه خیرهکننده بود: کاهش ۳۲ درصدی مصرف انرژی در فروشگاههای پایلوت. این موفقیت نشان داد که محاسبات لبهای تنها یک بحث فنی نیست، بلکه یک محرک مستقیم برای سودآوری و پایداری زیستمحیطی است.24

۴.۳ زیمنس و اینترنت اشیاء صنعتی (IIoT)

در بخش تولید صنعتی، شرکت زیمنس با پلتفرم Industrial Edge خود پیشگام شده است. در سال ۲۰۲۵، کارخانهها دیگر تمایلی به ارسال دادههای حساس تولیدی به ابر عمومی ندارند، هم به دلایل امنیتی و هم به دلیل نیاز به واکنشهای میلیثانیهای رباتها و خطوط تولید. پلتفرم زیمنس با آوردن قدرت پردازش IT به طبقه تولید (OT)، امکان تحلیل دادهها، پیشبینی خرابی دستگاهها (Predictive Maintenance) و کنترل کیفیت بصری با هوش مصنوعی را بدون خروج داده از محیط کارخانه فراهم کرده است.27 این رویکرد ترکیبی، مزایای ابر (مانند مدیریت متمرکز و آپدیت نرمافزار) را با مزایای سیستمهای محلی (امنیت و سرعت) ترکیب میکند.

فصل پنجم: واقعیتهای کوانتومی و امنیت سایبری آینده

۵.۱ از آزمایشگاه تا سرویس: ظهور QaaS

محاسبات کوانتومی در سال ۲۰۲۵ از فاز تحقیقات بنیادی عبور کرده و وارد فاز کاربرد تجاری اولیه شده است. اگرچه هنوز تا رسیدن به رایانههای کوانتومی تحملکننده خطا (Fault-Tolerant) فاصله داریم، اما مدل ارائه «کوانتوم به عنوان سرویس» (Quantum-as-a-Service یا QaaS) دسترسی به پردازندههای کوانتومی موجود (مانند پردازندههای مبتنی بر اتمهای خنثی یا یونهای به دام افتاده) را برای سازمانها ممکن کرده است.29

شرکتهای پیشرو در صنایعی مانند داروسازی، مواد شیمیایی و مالی در حال استفاده از این سرویسها برای حل مسائلی هستند که برای ابررایانههای کلاسیک غیرممکن است. به عنوان مثال، شبیهسازی دقیق ساختار مولکولی برای کشف داروهای جدید یا بهینهسازی پورتفولیوهای مالی با هزاران متغیر در کسری از ثانیه. جیپی مورگان چیس (JPMorgan Chase) سرمایهگذاری ۱۰ میلیارد دلاری در فناوریهای نوین از جمله کوانتوم انجام داده است تا بتواند در تحلیل ریسک و قیمتگذاری مشتقات مالی پیشتاز باشد.31

۵.۲ تهدید “Q-Day” و استانداردسازی PQC

همزمان با وعدههای شیرین کوانتوم، کابوس امنیتی آن نیز در سال ۲۰۲۵ پررنگتر شده است. الگوریتم شور (Shor’s Algorithm) به رایانههای کوانتومی اجازه میدهد تا رمزنگاریهای نامتقارن فعلی (مانند RSA و ECC) که پایه امنیت اینترنت و تراکنشهای بانکی هستند را بشکنند. تهدید اصلی در حال حاضر، استراتژی “Harvest Now, Decrypt Later” (اکنون ذخیره کن، بعداً رمزگشایی کن) است که توسط گروههای هکری و دولتهای متخاصم اجرا میشود. آنها دادههای رمزنگاری شده حساس را سرقت و ذخیره میکنند تا در روزی که رایانه کوانتومی قدرتمند ساخته شد (Q-Day)، آنها را رمزگشایی کنند.33

در واکنش به این تهدید وجودی، موسسه ملی استاندارد و فناوری آمریکا (NIST) در آگوست ۲۰۲۴ اولین سری از استانداردهای نهایی رمزنگاری پسا-کوانتوم (PQC) را منتشر کرد. این استانداردها شامل الگوریتمهای ML-KEM (برای تبادل کلید)، ML-DSA و SLH-DSA (برای امضای دیجیتال) هستند.34

در سال ۲۰۲۵، مهاجرت به این استانداردهای جدید برای سازمانهای دولتی و زیرساختهای حیاتی به یک الزام تبدیل شده است. این فرآیند بسیار پیچیده است، زیرا نیازمند شناسایی تمام نقاطی است که در آن از رمزنگاری استفاده میشود (Cryptographic Inventory) و جایگزینی آن با الگوریتمهای جدید بدون اختلال در سرویس. کارشناسان هشدار میدهند که این مهاجرت ممکن است ۵ تا ۸ سال طول بکشد، بنابراین شروع آن در سال ۲۰۲۵ حیاتی است.36

فصل ششم: عملیات مالی (FinOps) و اقتصاد هوش مصنوعی

۶.۱ بلوغ FinOps در عصر هوش مصنوعی

در سال ۲۰۲۵، FinOps از یک دیسیپلین صرفاً مربوط به کاهش هزینه، به یک واحد استراتژیک برای همسوسازی سرمایهگذاریهای تکنولوژی با اهداف تجاری تبدیل شده است. با ورود هوش مصنوعی، پیچیدگیهای مدیریت هزینه چند برابر شده است. برخلاف هزینههای قابل پیشبینی زیرساختهای سنتی، هزینههای GenAI نوسانات شدیدی دارد و مستقیماً به رفتار کاربران و ماهیت درخواستها وابسته است.

تحلیلها نشان میدهد که چرخه عمر هزینه در پروژههای هوش مصنوعی شامل سه مرحله متمایز است که هر کدام نیازمند استراتژی FinOps خاص خود هستند:

- ساخت و آزمایش (Build): هزینههای نسبتاً پایین و ثابت برای آمادهسازی دادهها و آزمایش مدلهای کوچک.

- آموزش (Train): هزینههای بسیار سنگین، ناگهانی و کوتاه مدت (Spiky) برای اجاره کلاسترهای بزرگ GPU. در این مرحله، استفاده از ظرفیتهای Spot و رزرو شده حیاتی است.

- استنتاج (Inference): هزینههای جاری و وابسته به مقیاس که میتواند به سرعت از کنترل خارج شود. اینجا جایی است که بهینهسازی مدل و استفاده از سختافزار مناسب (مثلاً استفاده از تراشههای تخصصی استنتاج مانند AWS Inferentia) اهمیت پیدا میکند.20

۶.۲ واحد اقتصادی جدید (Unit Economics)

سازمانهای پیشرو در سال ۲۰۲۵ دیگر به “هزینه کل” نگاه نمیکنند، بلکه بر “هزینه واحد” (Unit Economics) تمرکز دارند. سوال کلیدی این است: “هزینه هر توکن تولید شده چقدر است و چه ارزشی برای کسبوکار ایجاد میکند؟”

برای مدیریت این فضا، مدلهای قیمتگذاری جدیدی شکل گرفته است و تیمهای FinOps و مهندسی باید همکاری نزدیکی داشته باشند تا با استفاده از تکنیکهایی مانند “Model Routing” (ارسال درخواستهای ساده به مدلهای ارزان و درخواستهای پیچیده به مدلهای گران)، تعادل بهینهای میان کیفیت پاسخ و هزینه برقرار کنند.19

فصل هفتم: حاکمیت داده و تضاد قوانین بینالمللی

۷.۱ اروپا در برابر آمریکا: نبرد حقوقی دادهها

فضای ابری در سال ۲۰۲۵ میدان نبرد قوانین متضاد است. از یک سو، قانون CLOUD Act ایالات متحده به مراجع قضایی این کشور اجازه میدهد تا به دادههای ذخیره شده توسط شرکتهای آمریکایی (مانند مایکروسافت، گوگل و آمازون) در هر جای دنیا دسترسی داشته باشند. از سوی دیگر، اتحادیه اروپا با اجرای قانون داده (EU Data Act) که از سپتامبر ۲۰۲۵ لازمالاجرا شده، موانع سختگیرانهای برای حفاظت از دادههای شهروندان و دادههای صنعتی ایجاد کرده است.39

قانون داده اتحادیه اروپا (EU Data Act) نه تنها بر حریم خصوصی تمرکز دارد، بلکه هدف آن شکستن انحصار غولهای ابری است. این قانون الزام میکند که ارائهدهندگان ابری باید هزینههای انتقال داده (Switching Fees) را حذف کنند و استانداردهای باز برای قابلیت همکاری (Interoperability) را بپذیرند تا مشتریان بتوانند به راحتی بین سرویسدهندگان مختلف جابجا شوند.41

۷.۲ راهکارهای فنی برای حاکمیت (Sovereign Cloud)

برای حل این پارادوکس حقوقی، مفهوم “Sovereign Cloud” (ابر مستقل/حاکمیتی) تکامل یافته است. شرکتهای ابری اکنون معماریهایی ارائه میدهند که در آن کنترل فنی دادهها کاملاً در اختیار مشتری است. با استفاده از تکنولوژیهایی مانند “مدیریت کلید خارجی” (External Key Management)، مشتریان کلیدهای رمزنگاری خود را در ماژولهای سختافزاری (HSM) نگهداری میکنند که ارائهدهنده ابری به آن دسترسی ندارد.

علاوه بر این، استفاده از “محیطهای اجرای امن” (Trusted Execution Environments – TEE) یا همان “محاسبات محرمانه” (Confidential Computing) به مشتریان اجازه میدهد تا دادههای خود را حتی در حین پردازش در حافظه رم نیز رمزنگاری شده نگه دارند. این فناوری تضمین میکند که حتی با حکم قضایی یا دسترسی فیزیکی به سرور، ارائهدهنده ابری نمیتواند محتوای دادهها را مشاهده کند.43

فصل هشتم: انرژی و پایداری؛ بازگشت به هستهای

۸.۱ پارادوکس هوش مصنوعی و محیط زیست

سال ۲۰۲۵ سالی است که واقعیتهای فیزیکی مصرف انرژی، رویاهای دیجیتال هوش مصنوعی را به چالش کشیده است. دیتاسنترهای مدرن هوش مصنوعی اشتهای سیریناپذیری برای برق دارند. برآوردها نشان میدهد که تا سال ۲۰۳۰، دیتاسنترها به تنهایی مسئول ۳۵ درصد از افزایش تقاضای برق در شبکه ایالات متحده خواهند بود.45 این افزایش تقاضا، تعهدات زیستمحیطی (Net Zero) شرکتهای بزرگ فناوری را به خطر انداخته است، زیرا انرژیهای تجدیدپذیر مانند باد و خورشید به دلیل ماهیت متناوب خود، قادر به تأمین برق پایدار (Baseload) مورد نیاز دیتاسنترهای ۲۴/۷ نیستند.

۸.۲ رنسانس هستهای: مایکروسافت، گوگل و SMRها

در یک چرخش استراتژیک تاریخی، غولهای فناوری برای حل بحران انرژی خود به انرژی هستهای روی آوردهاند. نمادینترین رویداد سال ۲۰۲۵، قرارداد ۲۰ ساله مایکروسافت با شرکت Constellation Energy برای بازگشایی و فعالسازی مجدد واحد ۱ نیروگاه هستهای “Three Mile Island” است. این قرارداد ۸۳۵ مگاوات برق پاک و پایدار را برای دیتاسنترهای مایکروسافت تضمین میکند و نشاندهنده تغییر نگاه عمومی و تجاری به انرژی هستهای است.46

همزمان، گوگل و آمازون بر روی نسل جدید راکتورها یعنی “راکتورهای کوچک مدولار” (SMR) شرطبندی کردهاند. گوگل در اکتبر ۲۰۲۴ قراردادی تاریخی با Kairos Power برای خرید ۵۰۰ مگاوات برق از راکتورهای SMR امضا کرد که قرار است تا سال ۲۰۳۰ وارد مدار شوند. این راکتورها به دلیل اندازه کوچک، ایمنی بالا و قابلیت تولید در کارخانه، میتوانند مستقیماً در کنار دیتاسنترها نصب شوند و نیاز به انتقال برق در مسافتهای طولانی را حذف کنند.47 این همگرایی بین صنعت ابری و صنعت هستهای، یکی از مهمترین روندهای زیرساختی دهه آینده خواهد بود.

فصل نهم: مهندسی پلتفرم و تجربه توسعهدهنده

۹.۱ مقابله با پیچیدگی: ظهور IDPها

با گسترش معماریهای میکروسرویس، کوبرنتیز و چند-ابری، پیچیدگی عملیاتی برای توسعهدهندگان نرمافزار به شدت افزایش یافته است. بار شناختی (Cognitive Load) ناشی از نیاز به درک زیرساخت، شبکهسازی و امنیت، بهرهوری توسعهدهندگان را کاهش داده است. در پاسخ، سال ۲۰۲۵ سال اوجگیری “مهندسی پلتفرم” (Platform Engineering) است.

هدف این رویکرد، ساخت “پلتفرمهای توسعه داخلی” (Internal Developer Platforms – IDP) است که به عنوان یک لایه انتزاعی عمل میکنند. این پلتفرمها به توسعهدهندگان اجازه میدهند تا به صورت خود-سرویس (Self-Service) منابع مورد نیاز خود را دریافت کنند، بدون اینکه نیاز باشد با پیچیدگیهای زیرساخت درگیر شوند.48 ابزارهایی مانند Backstage (که توسط Spotify متنباز شد) و پلتفرمهای تجاری مانند Port، به استانداردی برای ساخت این پلتفرمها تبدیل شدهاند. آمارهای سال ۲۰۲۵ نشان میدهد که سازمانهایی که IDPهای موفقی پیادهسازی کردهاند، سرعت توسعه خود را افزایش داده و نرخ ریزش توسعهدهندگان را به دلیل بهبود “تجربه توسعهدهنده” (DevEx) کاهش دادهاند.49

نتیجهگیری و چشمانداز استراتژیک

تحلیل جامع روندهای سال ۲۰۲۵ و فراتر از آن نشان میدهد که صنعت رایانش ابری در حال تجربه یک دگردیسی کامل است. ما از دوران “اجاره سرور” عبور کرده و به عصر “محاسبات هوشمند، توزیعشده و تخصصی” وارد شدهایم.

پیامدهای کلیدی و توصیههای راهبردی:

- استراتژی زیرساخت ترکیبی: دوران “یک ابر برای همه چیز” به پایان رسیده است. سازمانهای موفق از ترکیب استراتژیک هایپراسکیلرها (برای سرویسهای عمومی)، نئوکلادها (برای آموزش ارزانتر هوش مصنوعی) و لبه شبکه (برای پردازش بلادرنگ) استفاده میکنند.

- امنیت کوانتومی به عنوان فوریت: مدیران ارشد امنیت (CISOs) نباید منتظر ساخت کامپیوتر کوانتومی بمانند. فرآیند شناسایی داراییهای رمزنگاری شده و برنامهریزی برای مهاجرت به استانداردهای PQC باید همین امروز آغاز شود.

- پایداری واقعی انرژی: استراتژی انرژی دیتاسنترها دیگر نمیتواند بر پایه اعتبارات کربن (Carbon Credits) باشد. تأمین فیزیکی انرژی پاک و پایدار (مانند قراردادهای هستهای) شرط بقای عملیاتی در دهه ۲۰۳۰ خواهد بود.

- بازتعریف استعدادها: با اتوماسیون وظایف زیرساختی توسط هوش مصنوعی و پلتفرمهای مهندسی، تقاضا برای مهندسان “DevOps سنتی” کاهش یافته و نیاز به “مهندسان پلتفرم” و متخصصان FinOps که زبان پول و تکنولوژی را همزمان میفهمند، افزایش خواهد یافت.

آینده رایانش ابری روشن، اما پیچیده است. برندگان این عصر کسانی نیستند که صرفاً تکنولوژی جدید را میخرند، بلکه کسانی هستند که معماری سازمانی، مدلهای مالی و فرهنگ کاری خود را برای همزیستی با هوش مصنوعی، کوانتوم و واقعیتهای جدید انرژی بازآفرینی میکنند.